具身智能机器人学习路线全解析

一、引言

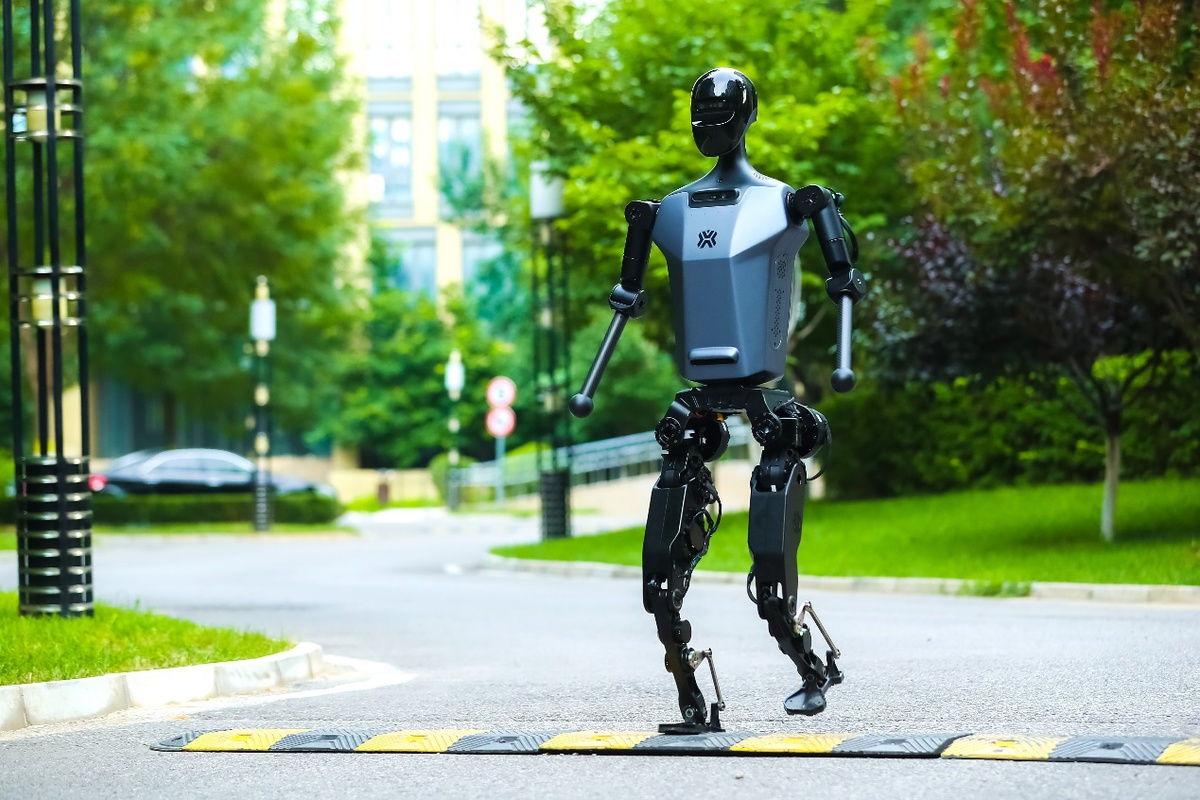

具身智能机器人作为融合了机器人学、人工智能、认知科学等多领域知识的前沿技术,正逐渐改变着我们的生活和工作方式。从工业制造到家庭服务,从医疗护理到太空探索,具身智能机器人都展现出了巨大的潜力。对于想要深入了解和学习这一领域的人来说,构建一个系统的学习路线至关重要。

二、基础理论学习

(一)数学基础

- 线性代数:理解向量、矩阵运算,用于机器人运动学和动力学建模。例如,通过齐次变换矩阵描述机器人关节的位置和姿态变化。

- 微积分:掌握导数、积分概念,在机器人控制中用于计算速度、加速度等物理量,优化机器人的运动轨迹。

- 概率论与数理统计:处理机器人感知中的不确定性,如传感器噪声,通过概率模型进行状态估计和决策。

(二)物理基础

- 力学:包括牛顿力学、刚体力学,了解机器人在运动过程中的受力分析,为设计机器人的结构和控制算法提供依据。

- 运动学:研究机器人关节的运动关系,确定机器人末端执行器的位置和姿态,是机器人编程的基础。

- 动力学:探讨机器人运动与力之间的关系,分析机器人在不同负载和运动状态下的动力需求。

(三)编程基础

- Python:作为具身智能机器人领域广泛使用的编程语言,具备丰富的库和工具,如 NumPy 用于数值计算,SciPy 用于科学计算,Matplotlib 用于数据可视化。

- C++:在对实时性要求较高的机器人系统中,C++ 常被用于底层开发,提高系统的运行效率。

三、机器人学知识

(一)机器人结构与设计

- 机械结构:学习机器人的机械本体,如关节、连杆的设计原理,了解不同类型机器人(如串联机器人、并联机器人)的结构特点。

- 驱动系统:熟悉电机、舵机等驱动装置的工作原理和控制方法,掌握如何根据机器人的负载和运动要求选择合适的驱动设备。

- 传感器技术:了解各类传感器,如摄像头、激光雷达、力传感器、陀螺仪等在机器人感知中的应用,掌握传感器数据的采集和处理方法。

(二)机器人运动控制

- 运动规划:学习路径规划算法,如 A * 算法、Dijkstra 算法,用于为机器人规划从起始点到目标点的无碰撞路径。

- 轨迹控制:掌握机器人关节空间和笛卡尔空间的轨迹生成方法,实现机器人的平滑运动。

- 反馈控制:基于传感器反馈,采用 PID 控制、自适应控制等算法,调整机器人的运动参数,确保机器人准确跟踪目标轨迹。

四、人工智能技术

(一)机器学习

- 监督学习:学习分类和回归算法,如决策树、支持向量机、神经网络,用于机器人的模式识别和状态预测。

- 无监督学习:了解聚类、降维等算法,帮助机器人对大量的感知数据进行分析和理解。

- 强化学习:通过与环境进行交互,根据奖励信号学习最优策略,使机器人能够在复杂环境中自主决策和学习。

(二)计算机视觉

- 图像基础:掌握图像的基本处理方法,如滤波、边缘检测、特征提取,为机器人的视觉感知提供基础。

- 目标检测与识别:学习基于深度学习的目标检测算法,如 YOLO、Faster R-CNN,实现机器人对环境中物体的识别和定位。

- 视觉 SLAM:同时定位与地图构建,使机器人能够根据视觉信息创建环境地图,并在地图中实时定位自身位置。

五、案例分析

(一)波士顿动力公司的 Atlas 机器人

- 特点:具备高度的动态平衡能力和复杂的运动技能,能够在各种地形上行走、奔跑、跳跃,还能完成开门、搬运物体等任务。

- 技术实现:结合了先进的机器人运动控制算法、高精度的传感器和强大的计算能力,通过强化学习不断优化自身的运动策略。

(二)谷歌的 AI 机器人

- 特点:能够通过视觉和触觉感知与环境进行交互,自主学习完成各种复杂的操作任务,如在杂乱的环境中抓取不同形状的物体。

- 技术实现:利用深度学习算法对大量的视觉和触觉数据进行训练,实现机器人对物体形状、位置和物理特性的理解,从而实现精准的操作。

六、代码示例

(一)使用 Python 和 OpenCV 进行简单的图像识别

import cv2

import numpy as np# 加载预训练的Haar级联分类器

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')# 读取图像

img = cv2.imread('test.jpg')

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)# 检测人脸

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))# 在图像上绘制矩形框标记人脸

for (x, y, w, h) in faces:cv2.rectangle(img, (x, y), (x + w, y + h), (0, 255, 0), 2)# 显示结果图像

cv2.imshow('Face Detection', img)

cv2.waitKey(0)

cv2.destroyAllWindows()(二)使用 Python 和 PyTorch 实现简单的神经网络进行手写数字识别

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms# 数据预处理

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize((0.5,), (0.5,))])# 加载训练集和测试集

train_dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST(root='./data', train=False, download=True, transform=transform)train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=64, shuffle=True)

test_loader = torch.utils.data.DataLoader(test_dataset, batch_size=64, shuffle=False)# 定义神经网络模型

class Net(nn.Module):def __init__(self):super(Net, self).__init__()self.fc1 = nn.Linear(28 * 28, 128)self.fc2 = nn.Linear(128, 64)self.fc3 = nn.Linear(64, 10)def forward(self, x):x = x.view(-1, 28 * 28)x = torch.relu(self.fc1(x))x = torch.relu(self.fc2(x))x = self.fc3(x)return x# 初始化模型、损失函数和优化器

model = Net()

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.9)# 训练模型

for epoch in range(10):running_loss = 0.0for i, data in enumerate(train_loader, 0):inputs, labels = dataoptimizer.zero_grad()outputs = model(inputs)loss = criterion(outputs, labels)loss.backward()optimizer.step()running_loss += loss.item()if i % 100 == 99:print(f'Epoch {epoch + 1}, Step {i + 1}, Loss: {running_loss / 100:.3f}')running_loss = 0.0# 测试模型

correct = 0

total = 0

with torch.no_grad():for data in test_loader:images, labels = dataoutputs = model(images)_, predicted = torch.max(outputs.data, 1)total += labels.size(0)correct += (predicted == labels).sum().item()print(f'Accuracy of the network on the 10000 test images: {100 * correct / total}%')七、总结

具身智能机器人的学习是一个长期而复杂的过程,需要不断积累理论知识和实践经验。通过系统地学习数学、物理、编程、机器人学和人工智能等多方面的知识,结合实际案例和代码实践,相信你能够逐步掌握具身智能机器人的核心技术,为这一领域的发展贡献自己的力量。