基于深度学习的图像压缩技术(二)

3 基于生成对抗神经网络的图像压缩技术

生成对抗网络是一种先进的无监督学习算法,由Goodfellow等人在2014 年首次提出,其核心思想源于博弈论。

生成对抗网络在图像压缩中的应用主要通过生成器和判别器的协作实现高质量的图像重构。

生成器负责从压缩比特流中解码并重建图像,而判别器则对生成图像的真实性进行评估,并将反馈用于优化生成器的参数。通过这种对抗训练,GAN 能够在低比特率条件下生成具有高视觉质量的图像。

具体而言,GAN 框架通过引入对抗损失和感知损失,优化生成图像的视觉保真度。对抗损失确保生成图像的分布与原始图像接近,而感知损失则注重图像细节的保留,减少伪影和模糊问题。因此,利用GAN,可以通过学习图像的编码信息并重建图像,从而显著减少图像数据量。

这种方法不仅能够实现高效的图像压缩,还能在解压或重建过程中保持图像质量,使得压缩后的图像在视觉上非常接近原始图像。

GAN 通过生成器和判别器的对抗训练,在图像压缩中实现了高压缩率和较好的视觉效果。其创新点在于能够重建出更具感知质量的图像,但对抗训练过程复杂,容易引入伪影或不期望的合成特征。未来研究可以关注对抗训练的稳定性优化、生成器轻量化设计,以及GAN 与其他压缩技术(如Transformer)的结合,以提升实际应用效果。

4 基于transformer的图像压缩技术

随着深度学习技术在图像压缩领域的不断深入发展,Transformer 技术的应用逐渐成为研究热点,展示了其在图像压缩领域的巨大潜力和独特优势。Wang等人提出了一种基于滑动窗口(Shifted Window,Swin) Transformer的端到端图像压缩框架,将Swin Transformer 模块应用于分析和合成阶段,与卷积层交替使用,从而更有效地捕捉图像中的局部和非局部相似性,显著降低了编码率和失真率。

这种结合局部和全局特征的方法,使模型在自然场景和屏幕内容图像中均表现优异。

此外,Wang等人开发了一种增强残差SwinV2 Transformer 框架,通过特征增强模块和残差SwinV2 Transformer 块的协同作用,提升了非线性特征表示能力,同时降低了模型复杂度,实现了高压缩性能与低计算资源消耗的统一。

Transformer 架构在图像压缩领域展现出了显著优势,能够有效捕捉图像的全局特征和长距离依赖关系,在降低比特率的同时提升图像质量。

未来研究可进一步探索Transformer 与其他深度学习模型的结合方式,以及在不同应用场景下的优化策略,以推动图像压缩技术向更高效、更智能的方向发展。随着计算资源的持续进步和算法的不断优化,Transformer 在图像压缩中的应用前景将更加广阔,有望在实时视频传输、大规模图像存储等领域发挥更为重要的作用。

5 基于扩散模型的图像压缩技术

近年来,扩散模型已成为图像压缩领域的前沿方向。其通过模拟噪声添加和去噪过程,能够精准捕捉图像复杂的分布特性,实现高质量的图像重建,尤其在极低比特率、高分辨率和感知质量优化场景中表现出色。

扩散模型在图像压缩领域的应用已取得显著进展,不仅在极低比特率、高分辨率和感知优化等场景中展现出卓越性能,还为医学图像处理、多模态压缩和渐进式数据传输等提供了更多可能性。

然而,扩散模型在计算复杂度、推理速度和通用性方面仍有改进空间。未来研究可以进一步优化模型结构,通过结合其他深度学习技术(如GAN 和CNN)和设计轻量化扩散模型,实现高效压缩和更广泛的场景适配。

6 总结

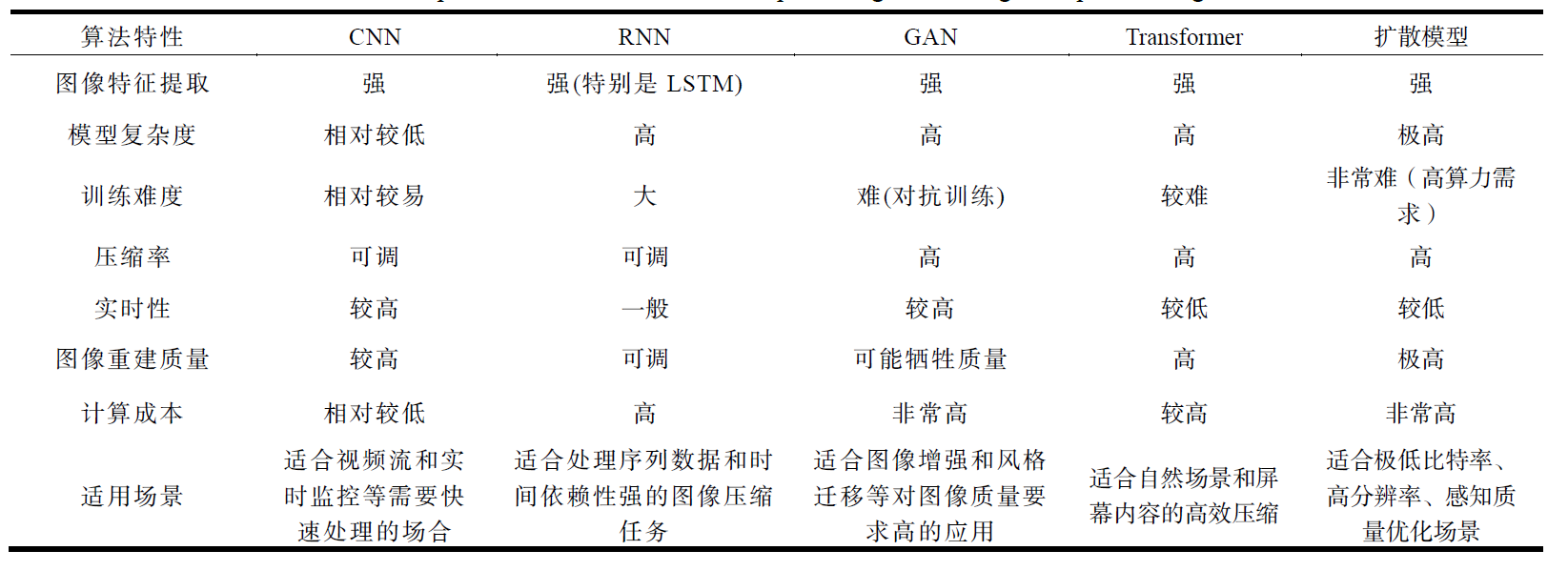

深度学习方法在图像压缩中的应用展现了显著的优势,基于深度学习的图像压缩算法特性比较如下表 所示。但其计算复杂度和推理速度在实际部署中往往成为关键挑战。这些问题在卷积神经网络、循环神经网络、生成对抗网络、Transformer 和扩散模型中表现各异。

以CNN 为例,其凭借高效的特征提取能力成为图像压缩任务的核心工具,但在处理高分辨率图像时,卷积操作带来的大量参数和计算需求显著增加,导致内存和计算资源的占用成为瓶颈。研究者提出了模型剪枝和量化等优化策略,通过去除冗余参数和降低精度需求来减少计算资源占用,同时借助GPU 或TPU 等硬件加速技术进一步提升了卷积操作的效率。

相比之下,RNN 在建模序列数据方面具有优势,尤其是长短期记忆网络在捕捉时间依赖性时表现出色,但其迭代计算特性使计算复杂度较高,训练难度相应增加。优化策略包括引入注意力机制替代传统RNN结构以提高建模效率,以及利用知识蒸馏技术将复杂模型的学习能力迁移至轻量化模型,从而减少资源消耗。

GAN 通过生成器和判别器的对抗训练在图像压缩中实现了高压缩率和较好的实时性,但对抗训练过程复杂,计算资源消耗较高,推理速度也受限。研究者提出了预训练生成器以减少对抗迭代次数,同时通过设计轻量化生成器架构和引入分布式计算框架来提升推理效率。然而,GAN 在对抗训练过程中有时会产生不期望的合成特征,这对压缩质量提出了进一步的优化需求。

Transformer 因其全局特征捕捉能力在图像压缩领域表现优异,尤其适用于自然场景和屏幕内容等复杂任务。然而,其多头注意力机制需要计算全局特征图的自注意力矩阵,计算复杂度随图像分辨率的提升而显著增加。近年来,研究者通过提出高效架构和混合设计,降低了计算成本,同时确保高效压缩。

扩散模型作为一种前沿技术,通过逐步去噪的方式为低比特率和高分辨率图像压缩提供了创新解决方案,尤其在医学图像、遥感图像以及带宽受限场景下表现出卓越性能。然而,其生成过程需要多步迭代推理,导致推理速度较慢、计算资源需求较高。针对这一问题,研究者提出了少步去噪和改进采样技术,以及模型量化和知识蒸馏方法,以减少计算开销并提升推理速度。这些优化策略显著降低了深度学习方法在图像压缩中的资源消耗,使其更适合资源受限的实际应用场景。

基于深度学习的图像压缩算法在特征提取方面相较于传统算法具有显著优势。

从CNN 到RNN 和GAN,再到Transformer 和扩散模型,研究的重点逐渐从特征提取的效率和精度转向压缩率、图像质量与计算成本之间的平衡。RNN 和GAN 大多以CNN 为基础模型进行特征提取,其中RNN 在序列建模方面表现强大,但长时间训练可能偏离梯度下降方向,而GAN 的对抗训练过程尽管有效提升了压缩效率, 但通常伴随着更高的计算成本。Transformer 和扩散模型则展现了在高压缩率和高质量图像重建方面的潜力,但其计算资源需求和复杂性限制了实际应用场景的广泛性。

综合来看,基于深度学习的图像压缩算法正不断推动该领域的发展。

从早期的CNN 到更复杂的RNN 和GAN,再到如今的Transformer 和扩散模型,研究的重点逐渐从特征提取的效率和精度转向对高压缩率和高质量图像重建的平衡。同时,如何降低模型的计算成本和训练难度,将成为未来研究的主要方向。

近年来大模型(Large Models)在图像处理领域的广泛应用也引发了研究者对其在图像压缩任务中潜力的探索。

大模型凭借其强大的特征建模能力和跨任务泛化能力,为高质量图像压缩和多功能应用提供了新的可能。

然而,受限于其巨大的计算资源需求和训练成本,目前关于大模型在图像压缩中的研究尚处于起步阶段。在本综述中,基于深度学习的方法并未深入讨论大模型的相关应用,但这一方向无疑为未来研究提供了重要的创新空间,也为图像压缩技术注入了更多发展的可能性。未来研究将继续探索提高压缩效率、保证图像质量与降低计算成本之间的最佳平衡点,为图像压缩技术注入更多创新动力。