采用自适应调整参数的 BP 网络学习改进算法详解

一、引言

BP(Back Propagation)神经网络是一种广泛应用于解决复杂非线性问题的有效工具,如模式识别、函数逼近、数据分类等领域。然而,传统的 BP 算法存在一些局限性,其中学习率和其他参数的固定设置往往导致训练效率低下、收敛速度慢甚至可能陷入局部最优解。为了克服这些问题,采用自适应调整参数的 BP 网络学习改进算法应运而生。本文将详细阐述这种改进算法的原理、步骤以及通过丰富的代码示例展示其实现过程。

二、传统 BP 网络学习算法概述

(一)网络结构与前向传播

BP 神经网络通常由输入层、若干隐藏层和输出层组成。假设输入层有 n n n 个神经元,输入向量为 x = ( x 1 , x 2 , ⋯ , x n ) \mathbf{x}=(x_1,x_2,\cdots,x_n) x=(x1,x2,⋯,xn);中间有 l l l 个隐藏层,第 i i i 个隐藏层有 h i h_i hi 个神经元;输出层有 m m m 个神经元,输出向量为 y = ( y 1 , y 2 , ⋯ , y m ) \mathbf{y}=(y_1,y_2,\cdots,y_m) y=(y1,y2,⋯,ym)。

在前向传播过程中,对于任意一层(以第 j j j 层为例),神经元的输入为:

n e t k j = ∑ i w i k j − 1 o i j − 1 + b k j net_{k}^{j}=\sum_{i}w_{ik}^{j - 1}o_{i}^{j - 1}+b_{k}^{j} netkj=∑iwikj−1oij−1+bkj

其中, w i k j − 1 w_{ik}^{j - 1} wikj−1 是第 j − 1 j - 1 j−1 层神经元 i i i 到第 j j j 层神经元 k k k 的连接权重, o i j − 1 o_{i}^{j - 1} oij−1 是第 j − 1 j - 1 j−1 层神经元 i i i 的输出, b k j b_{k}^{j} bkj 是第 j j j 层神经元 k k k 的偏置。神经元的输出经过激活函数 f ( ⋅ ) f(\cdot) f(⋅) 处理,如常见的 Sigmoid 函数 f ( x ) = 1 1 + e − x f(x)=\frac{1}{1 + e^{-x}} f(x)=1+e−x1,即 o k j = f ( n e t k j ) o_{k}^{j}=f(net_{k}^{j}) okj=f(netkj)。

(二)误差计算与反向传播

对于训练样本集 { ( x ( p ) , t ( p ) ) } p = 1 P \{(\mathbf{x}^{(p)},\mathbf{t}^{(p)})\}_{p = 1}^{P} {(x(p),t(p))}p=1P,其中 x ( p ) \mathbf{x}^{(p)} x(p) 是第 p p p 个输入样本, t ( p ) \mathbf{t}^{(p)} t(p) 是对应的目标输出。误差通常采用均方误差(MSE)衡量:

E = 1 2 P ∑ p = 1 P ∑ k = 1 m ( y k ( p ) − t k ( p ) ) 2 E=\frac{1}{2P}\sum_{p = 1}^{P}\sum_{k = 1}^{m}(y_{k}^{(p)}-t_{k}^{(p)})^{2} E=2P1∑p=1P∑k=1m(yk(p)−tk(p))2

在反向传播过程中,根据误差函数对权重的梯度来更新权重。以输出层到最后一个隐藏层的权重更新为例,通过链式法则计算权重 w k m l w_{km}^{l} wkml 的梯度:

∂ E ∂ w k m l = ∑ p = 1 P ∂ E ∂ y m ( p ) ∂ y m ( p ) ∂ n e t m l ∂ n e t m l ∂ w k m l \frac{\partial E}{\partial w_{km}^{l}}=\sum_{p = 1}^{P}\frac{\partial E}{\partial y_{m}^{(p)}}\frac{\partial y_{m}^{(p)}}{\partial net_{m}^{l}}\frac{\partial net_{m}^{l}}{\partial w_{km}^{l}} ∂wkml∂E=∑p=1P∂ym(p)∂E∂netml∂ym(p)∂wkml∂netml

然后根据梯度下降法更新权重:

w k m l ( t + 1 ) = w k m l ( t ) − η ∂ E ∂ w k m l w_{km}^{l}(t + 1)=w_{km}^{l}(t)-\eta\frac{\partial E}{\partial w_{km}^{l}} wkml(t+1)=wkml(t)−η∂wkml∂E

其中, η \eta η 是学习率, t t t 表示训练次数。类似地,可以计算其他层之间的权重更新公式。

三、传统 BP 算法的问题分析

(一)固定学习率问题

- 收敛速度不稳定

在传统 BP 算法中,学习率是一个固定值。如果学习率设置过大,可能会导致权重更新幅度过大,使得网络在训练过程中跳过误差曲面的最小值点,甚至可能导致训练过程不收敛。相反,如果学习率设置过小,权重更新缓慢,会导致训练时间过长,尤其在处理复杂的高维数据时问题更加突出。 - 对不同训练阶段适应性差

在训练初期,误差曲面通常较为平坦,较大的学习率有助于快速接近最优解区域。但在训练后期,当接近最优解时,误差曲面变得更加复杂,需要较小的学习率来精确调整权重以避免越过最小值点。固定学习率无法满足这种不同训练阶段的需求。

(二)其他固定参数的局限性

除了学习率,BP 算法中的一些其他参数,如动量项(如果有)、权重初始化范围等,在传统算法中通常也是固定的。这些固定参数在不同的数据集和应用场景下可能无法达到最优的训练效果,进一步限制了网络的性能。

四、自适应调整参数的 BP 网络学习改进算法原理

(一)自适应学习率调整策略

- 基于梯度信息调整

一种常见的方法是根据每次迭代中误差函数对权重的梯度大小来调整学习率。如果当前梯度较大,说明当前权重更新方向可能距离最优解较远,可以适当增大学习率以加快收敛速度;如果梯度较小,接近最优解区域,则减小学习率以避免跳过最小值。例如,可以采用以下简单的调整规则:

η ( t + 1 ) = { γ η ( t ) , if ∥ ∂ E ∂ w ( t ) ∥ > θ β η ( t ) , if ∥ ∂ E ∂ w ( t ) ∥ ≤ θ \eta(t + 1)=\begin{cases} \gamma\eta(t), & \text{if } \|\frac{\partial E}{\partial w}(t)\| > \theta\\ \beta\eta(t), & \text{if } \|\frac{\partial E}{\partial w}(t)\| \leq \theta \end{cases} η(t+1)={γη(t),βη(t),if ∥∂w∂E(t)∥>θif ∥∂w∂E(t)∥≤θ

其中, γ > 1 \gamma > 1 γ>1 和 β < 1 \beta < 1 β<1 是调整系数, θ \theta θ 是一个阈值, t t t 是训练次数。

- 基于训练性能调整

还可以根据网络在训练集或验证集上的性能来调整学习率。如果在连续几个训练迭代中误差没有明显下降,甚至有上升趋势,可以减小学习率;反之,如果误差下降速度较快,可以适当增大学习率。例如,计算连续 k k k 次迭代的误差变化率:

Δ E r a t e = E ( t − k ) − E ( t ) E ( t − k ) \Delta E_{rate}=\frac{E(t - k)-E(t)}{E(t - k)} ΔErate=E(t−k)E(t−k)−E(t)

根据 Δ E r a t e \Delta E_{rate} ΔErate 的值来调整学习率,如当 Δ E r a t e > δ \Delta E_{rate} > \delta ΔErate>δ( δ \delta δ 为正阈值)时增大学习率,当 Δ E r a t e < − δ \Delta E_{rate} < -\delta ΔErate<−δ 时减小学习率。

(二)其他参数的自适应调整

-

自适应动量项调整

对于带有动量项的 BP 算法,动量系数也可以自适应调整。在训练初期,为了加速收敛,可以设置较大的动量系数,使权重更新具有较大的惯性;在训练后期,接近最优解时,减小动量系数,避免因惯性过大而错过最小值。例如,可以根据训练次数或当前误差值来调整动量系数。 -

自适应权重初始化范围调整

根据输入数据的特征和网络规模,自适应地确定权重初始化的范围。例如,如果输入数据的方差较大,可以适当增大权重初始化范围;如果网络层数较多,可以适当减小初始化范围以避免梯度消失或爆炸问题。

五、自适应调整参数的 BP 网络学习改进算法步骤

(一)初始化

- 权重和偏置初始化

根据自适应权重初始化范围调整策略确定合适的范围,随机初始化网络的连接权重 w i j w_{ij} wij 和偏置 b j b_{j} bj。 - 学习率和其他参数初始化

初始化学习率 η \eta η、动量系数(如果有)等其他参数。同时,设置用于自适应调整参数的相关参数,如调整系数、阈值等。

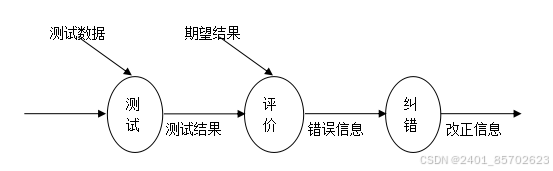

(二)训练过程

- 前向传播

对于每个训练样本,按照传统 BP 算法的前向传播方式计算网络的输出。 - 误差计算与反向传播

计算当前样本的误差,并根据误差进行反向传播计算梯度。 - 参数自适应调整

- 根据当前梯度信息或训练性能,按照自适应学习率调整策略调整学习率。

- 如果存在动量项,根据训练阶段调整动量系数。

- 权重更新

根据调整后的学习率(和动量系数,如果有)更新权重和偏置。 - 重复训练

对所有训练样本重复上述步骤,完成一次训练迭代(epoch)。多次重复训练迭代,直到满足训练停止条件,如达到预定的训练次数、误差小于某个阈值或验证集误差不再下降等。

六、代码示例

以下是一个简单的自适应调整学习率的 BP 网络 Python 代码示例:

import numpy as np# Sigmoid 激活函数

def sigmoid(x):return 1 / (1 + np.exp(-x))# Sigmoid 函数的导数

def sigmoid_derivative(x):return x * (1 - x)class NeuralNetwork:def __init__(self, input_size, hidden_size, output_size):self.input_size = input_sizeself.hidden_size = hidden_sizeself.output_size = output_size# 随机初始化权重self.W1 = np.random.rand(self.input_size, self.hidden_size)self.b1 = np.zeros((1, self.hidden_size))self.W2 = np.random.rand(self.hidden_size, self.output_size)self.b2 = np.zeros((1, self.output_size))self.learning_rate = 0.1 # 初始学习率self.gamma = 1.2 # 学习率增大系数self.beta = 0.8 # 学习率减小系数self.theta = 0.5 # 梯度阈值def forward_propagation(self, X):self.z1 = np.dot(X, self.W1) + self.b1self.a1 = sigmoid(self.z1)self.z2 = np.dot(self.a1, self.W2) + self.b2self.a2 = sigmoid(self.z2)return self.a2def back_propagation(self, X, y):m = X.shape[0]dZ2 = self.a2 - ydW2 = np.dot(self.a1.T, dZ2) / mdb2 = np.sum(dZ2, axis=0, keepdims=True) / mdZ1 = np.dot(dZ2, self.W2.T) * sigmoid_derivative(self.a1)dW1 = np.dot(X.T, dZ1) / mdb1 = np.sum(dZ1, axis=0, keepdims=True) / mreturn dW1, db1, dW2, db2def update_learning_rate(self, dW1, dW2):gradient_norm1 = np.mean(np.sqrt(np.sum(dW1 ** 2, axis=1)))gradient_norm2 = np.mean(np.sqrt(np.sum(dW2 ** 2, axis=1)))if gradient_norm1 > self.theta or gradient_norm2 > self.theta:self.learning_rate *= self.gammaelse:self.learning_rate *= self.betadef update_weights(self, dW1, db1, dW2, db2):self.W1 -= self.learning_rate * dW1self.b1 -= self.learning_rate * db1self.W2 -= self.learning_rate * dW2self.b2 -= self.learning_rate * db2def train(self, X, y, epochs):for epoch in range(epochs):output = self.forward_propagation(X)dW1, db1, dW2, db2 = self.back_propagation(X, y)self.update_learning_rate(dW1, dW2)self.update_weights(dW1, db1, dW2, db2)if epoch % 100 == 0:error = np.mean((output - y) ** 2)print(f'Epoch {epoch}: Error = {error}, Learning Rate = {self.learning_rate}')

你可以使用以下方式测试这个神经网络:

# 示例用法

X = np.array([[0, 0], [0, 1], [1, 0], [1, 1]])

y = np.array([[0], [1], [1], [0]])

neural_network = NeuralNetwork(2, 3, 1)

neural_network.train(X, y, 1000)

七、总结

采用自适应调整参数的 BP 网络学习改进算法通过动态调整学习率和其他相关参数,有效地克服了传统 BP 算法中固定参数带来的问题。这种算法能够根据训练过程中的实际情况,如梯度大小、训练性能等,自动调整参数,提高了训练的效率和稳定性,减少了陷入局部最优解的可能性。代码示例展示了自适应学习率调整的简单实现,在实际应用中,可以进一步扩展和优化自适应调整策略,以适应更复杂的数据集和应用场景,从而进一步提升 BP 神经网络的性能。