在这篇文章中我将介绍TF-IDF有关的一些知识,包括其概念、应用场景、局限性以及相应的代码。

一、概念

TF-IDF(Term Frequency-Inverse Document Frequency)是一种广泛用于信息检索和文本挖掘中的统计方法,用于评估一个词在一个文档或文档集合中的重要性。TF-IDF值反映了词语的重要性,它由两部分组成:词频(Term Frequency, TF)和逆文档频率(Inverse Document Frequency, IDF)。

1.1 TF

Term Frequency (TF):

词频是指某个词在文档中出现的次数。它是衡量一个词在文档中重要性的一个基本指标。

计算公式为:

1.2 IDF

Inverse Document Frequency (IDF):

逆文档频率(IDF)是为了补偿词频(TF)的不足而引入的概念。IDF的作用是降低那些在很多文档中都出现的词的重要性,同时提高那些在较少文档中出现的词的重要性。换句话说,IDF试图捕捉一个词的独特性和区分能力。

计算公式为:

其中:

其中 N 是文档总数,

df(t)是包含词 t 的文档数量,

+1是为了避免 df(t)为0时导致的分母为0问题。

1.3 TF-IDF

TF-IDF是TF和IDF的乘积,综合考虑了词频和逆文档频率两个因素。这样既反映了词语在文档中的重要性,又考虑了词语的独特性。

因此,其计算公式为:

二、应用场景

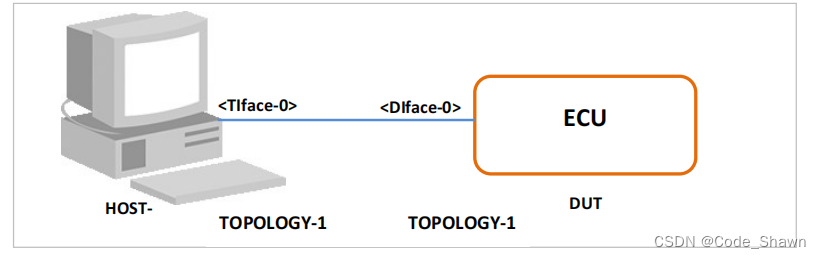

信息检索:在搜索引擎中,可以通过对于TF-IDF的计算来寻找目标目标文档。其中,关于检索模型可以分为布尔模型、向量模型、概率模型这三大种。而其中的向量模型就会用到TF-IDF来计算相似度。

具体的,在向量空间模型中,每个文档和查询都被表示为一个向量,其中每个维度对应一个词汇的TF-IDF值。文档向量和查询向量之间的相似度通常是通过余弦相似度来计算的:

其中,A与B分别为文档向量和查询向量,而||A||与||B||则是其对应的模长。

举个例子:

假设我们有两个文档:

- Doc1: "这是一个测试文档"

- Doc2: "另一个测试文档"

我们需要用向量模型来计算得知其相似度。

假设词汇表为 ["这是", "一个", "测试", "文档", "另一个"]。

首先我们计算TF:

对于Doc1:

TF("测试",Doc1)=

对于Doc2:

TF("测试",Doc2)=

然后我们计算IDF:

假设我们的文档集合 D 包含这两个文档:

那么,

df("测试")=2

N=2

则有:IDF("测试",D)==

然后计算TF-IDF:

对于Doc1:

TF−IDF("测试",Doc1,D)=

对于Doc2:

TF−IDF("测试",Doc2,D)=

接着我们就可以构建文档向量了:

假设我们构建文档向量时,除了“测试”外还有其他词汇,构造向量如下:

A=[TF−IDF("这是"),TF−IDF("一个"),TF−IDF("测试"),TF−IDF("文档")]

B=[TF−IDF("另一个"),TF−IDF("测试"),TF−IDF("文档")]

具体数值为:

最后,就是计算其相似度:

使用余弦相似度计算 AA 和 BB 之间的相似度:

那么,我们带入A与B到计算公式里则可得:

文本分类:在文本分类任务中,TF-IDF用于提取文档的关键特征。通过计算文档中各个词的TF-IDF值,可以得到一组特征向量,这些向量可以输入到诸如朴素贝叶斯(Naive Bayes)、支持向量机(SVM)或其他机器学习算法中,用于训练模型并进行分类预测。

关键词提取:TF-IDF可以用于从文档中提取关键词。通过计算文档中每个词的TF-IDF值,可以选择TF-IDF值最高的若干词作为文档的关键词。这种方法广泛应用于摘要生成、文献检索等领域。

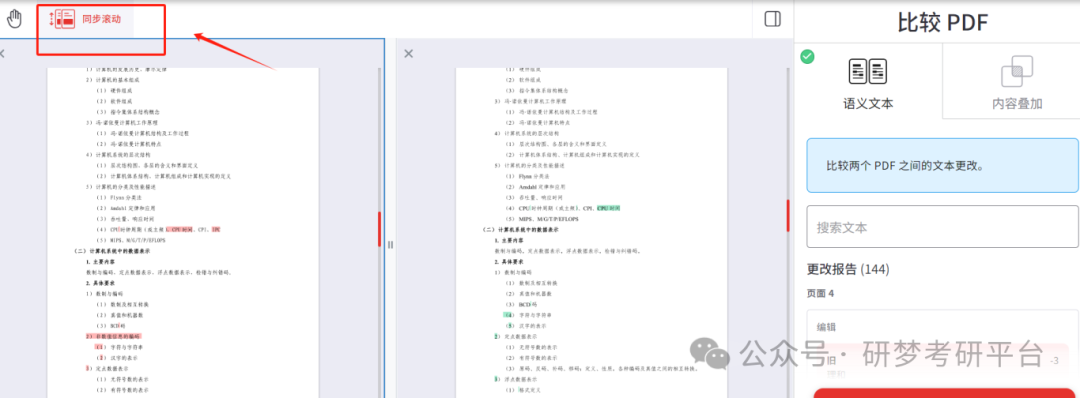

文章相似度计算:TF-IDF可以用于计算文档之间的相似度。通过计算两个文档中相同词汇的TF-IDF值,并使用余弦相似度(Cosine Similarity)等方法,可以评估文档之间的相似程度。这种方法在推荐系统、抄袭检测等方面有广泛应用。具体的相似度计算和上述的检索模型中向量模型的计算方式一致。

三、注意事项

在计算文档的TF-IDF时,我们要注意使用停用词库,像“一样”、“那么”、“还有”等词语虽然在文章中频繁出现,但实际意义不大,不能有助于我们区分不同文档间的差异,所以我们需要引入一个停用词库来筛选并剔除这些词语来。

然后,我们在计算文档的TF-IDF时,得到的往往是一个稀疏矩阵,它及占空间,所以我我们需要改变它的存储方式,就像如下图那样:

从这样的稀疏矩阵:

变为这样:

其中,可以看到元组内的第一项是特征,也就是词语所在的文档,第二项则是其在词汇表中索引位,至于元组后的小数,正是TF-IDF值。

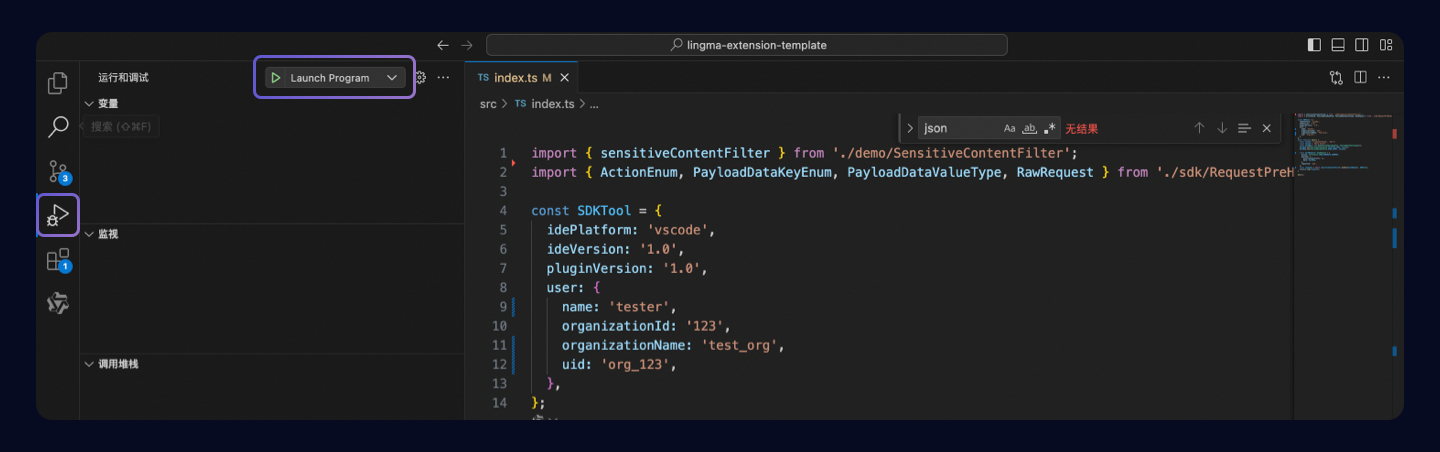

四、python实例

如下这个代码就是用sklearn中现成的函数来直接计算文章的TF-IDF,并且在其中因为是全是中文文档的缘故,我还引用了一个中文的停用词库。代码如下:

from sklearn.feature_extraction.text import TfidfVectorizer

import matplotlib.pyplot as plt

import pandas as pd

import numpy as np

import string

import jieba# 加载停用词

def load_stopwords(filepath):with open(filepath, 'r', encoding='utf-8') as file:stopwords = set(line.strip() for line in file)return list(stopwords)# 标点符号去除函数

def remove_punctuation(text):# 定义中文标点符号zh_punctuation = r'。\n !?。 "#$%&'()*+,-/:;<=>@[\]^_`{|}~⦅⦆「」、、〃《》「」『』【】〔〕〖〗〘〙〚〛〜〝〞〟〰〾〿–—‘’‛“”„‟…‧﹏'# 去除英文和中文标点符号translator = str.maketrans('', '', zh_punctuation + string.punctuation)try:text = str(text).translate(translator) # 确保text是字符串类型return text.strip()except Exception as e:print(f"Error processing text: {e}")return " "# 文本中文分词处理函数

def chinese_tokenizer(text):text = remove_punctuation(text)return " ".join(jieba.lcut(text))# 数据载入及预处理

path = r"C:\Users\20349\Desktop\ArtificialIntelligence\ML\kaggle\TF_IDF\chinese_news.csv"

data_all = pd.read_csv(path)

data_use = data_all.iloc[:500]

data_list = data_use.iloc[:,-1].tolist()

data = [chinese_tokenizer(text) for text in data_list]# 停用词库

stopwords_path = r"C:\Users\20349\Desktop\ArtificialIntelligence\wordCloud\stopWords.txt"

stopwords = load_stopwords(stopwords_path)# tfidf

vec = TfidfVectorizer(stop_words=stopwords)

X_tfidf = vec.fit_transform(data)

feature_name = vec.get_feature_names_out()

print(X_tfidf)

print(X_tfidf.toarray())

# 可视化

# 获取非零元素及其对应的TF-IDF值

rows, cols = X_tfidf.shape

for doc_index in range(rows):# 获取非零元素及其对应的TF-IDF值nonzero_features = X_tfidf.indices[X_tfidf.indptr[doc_index]:X_tfidf.indptr[doc_index + 1]]nonzero_values = X_tfidf.data[X_tfidf.indptr[doc_index]:X_tfidf.indptr[doc_index + 1]]# 排序

sorted_indices = np.argsort(nonzero_values)

sorted_nonzero_features = nonzero_features[sorted_indices]

sorted_nonzero_values = nonzero_values[sorted_indices]# 绘制TF-IDF散点图

plt.figure(figsize=(10, 6))

plt.scatter(range(len(sorted_nonzero_values)), sorted_nonzero_values, alpha=0.6, label=f'Document {doc_index}')

plt.xlabel('Feature Index Sorted by TF-IDF Value')

plt.ylabel('TF-IDF Value')

plt.title(f'TF-IDF Values for Document {doc_index} (Sorted)')

plt.grid(True)

plt.legend()

plt.show()

其画出的图像为:

这个图像是我筛选非0索引后排序得到的,但我们观察会发现其存在异常点,这是因为此时没有用停用词库,那么在加入停用词库后可以得到:

这样,最后那个异常的点就没有了。

如果我们不进行这样的压缩、排序,而是显示全部的索引项时,图像会是这样:

图像杂乱我们无法从中获取什么,所以需要一定的处理后才能再去绘制图表。

通过图像,我们可以得知文档的词汇间TF-IDF差值的具体大小,然后可以同过让词汇直接写在图表中的方法来得知最靠前的词汇是什么,而这些词汇就可以作为需要的文章标签来处理。

此上