常用UI设计工具及平台概览

在当今快速发展的数字世界中,UI设计平台成为设计师和开发者创建用户界面不可或缺的利器。这些平台不仅支持从简单原型到复杂交互设计的各种需求,而且许多还提供将设计直接转换为代码的功能,极大地提高了开发效率。下面将为您介绍几个主流的UI设计工具及其特点,帮助您根据项目需求选择最合适的工具。

Figma

Figma是业界领先的协作型界面设计工具,以其强大的实时协作功能著称,允许团队成员同时编辑同一设计文档。基于浏览器的设计使得无需安装任何软件即可开始工作,方便快捷。它不仅拥有丰富的原型设计和交互功能,还支持直接生成代码,简化了设计师与开发者之间的交接流程。此外,Figma拥有庞大的社区资源和插件库,适合处理复杂的团队合作项目。

地址:Figma: The Collaborative Interface Design Tool

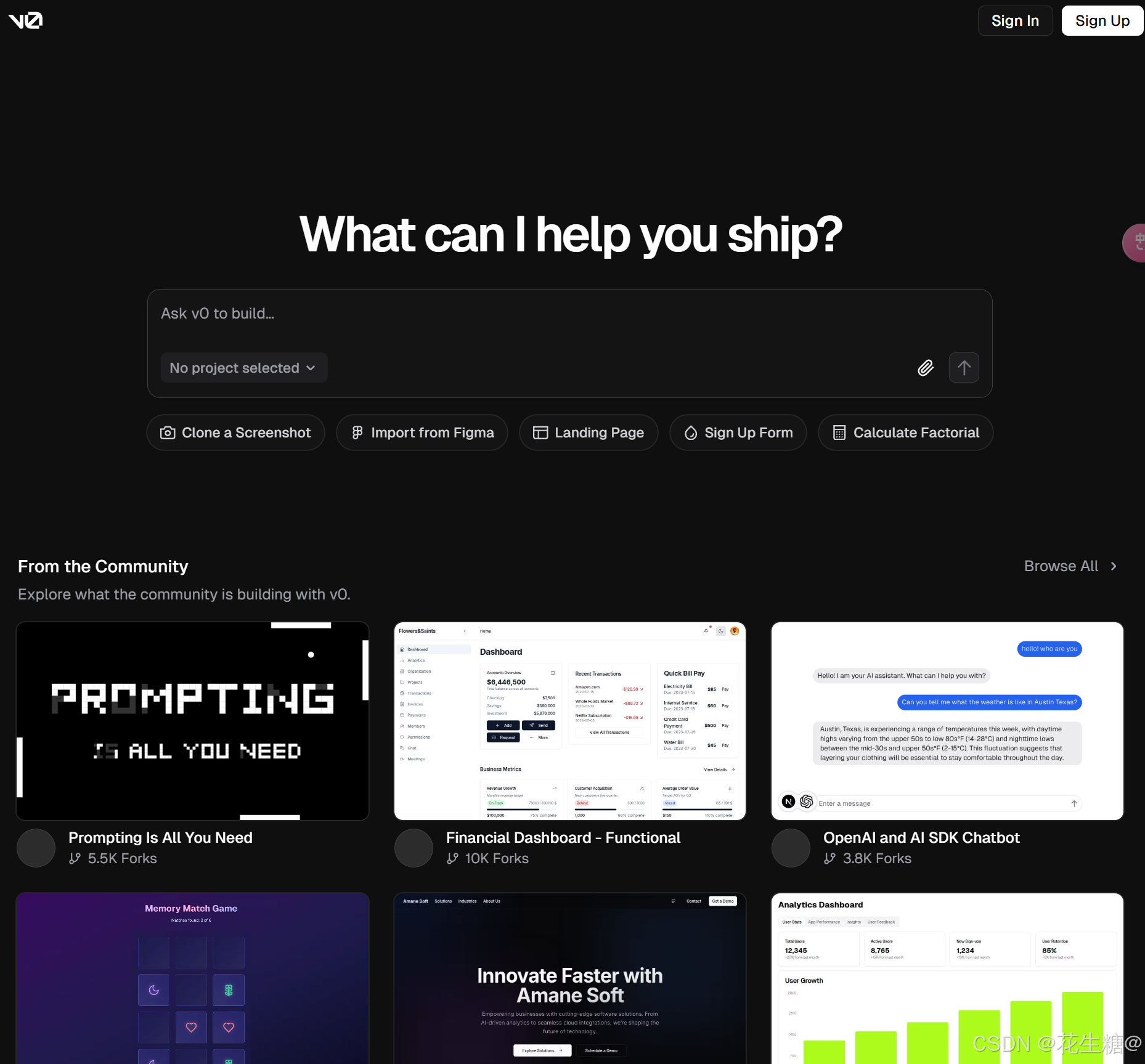

v0

v0是一款AI驱动的工具,能够根据描述或已有设计生成UI组件和应用程序,并且可以与Figma无缝集成。这款工具特别适合需要快速原型开发的场景,因为它能够大幅减少设计与开发之间的沟通障碍,让前端开发者能迅速获得所需的代码。

地址:v0 by Vercel

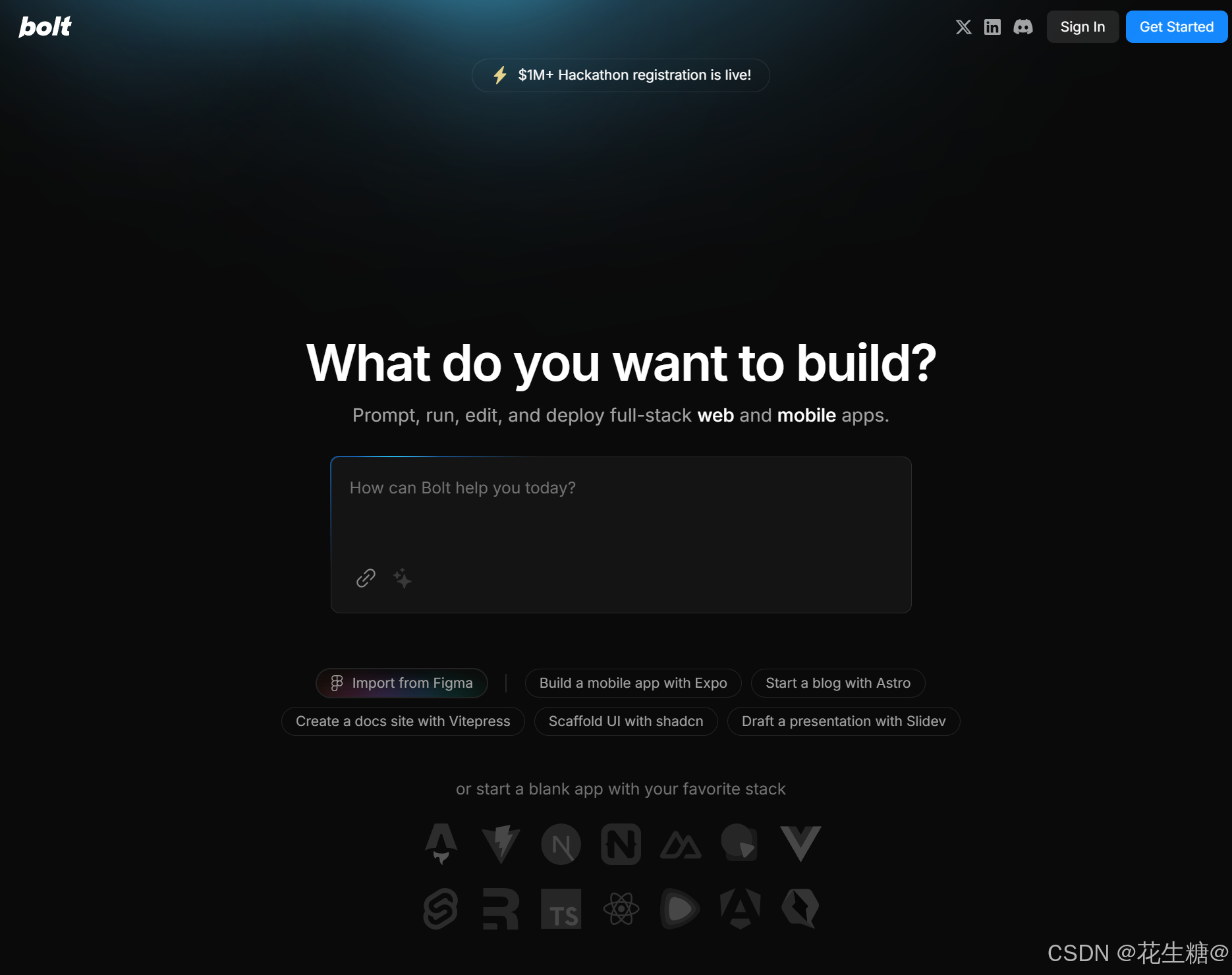

bolt.new (Bolt)

bolt.new是一个创新的AI全栈Web编程工具,旨在通过简化的开发流程让用户能够在浏览器中完成应用的构建、运行和部署。该平台非常适合初学者和个人开发者,因为其不需要复杂的配置,就能实现从概念到部署的完整开发周期。

地址:bolt.new

same.new

same.new提供了一种独特的方法来复制现有网站的UI,并自动生成React项目的代码。这种方法对于想要快速参考并实现现有设计的设计师来说非常有用,尤其是针对着陆页的快速复制。不过,对于更为复杂的页面,可能需要进行一些额外的调整以确保精确度。

地址:Same

Lovable

Lovable是一个通过自然语言描述即可创建全栈Web应用程序的AI平台。它不仅可以生成前端和后端代码,还能支持数据库和API的集成,适合那些希望快速迭代开发的技术和非技术用户。Lovable为用户提供了一个从想法到部署的完整解决方案。

地址:porkbun.com | parked domain

结论

随着技术的进步,特别是AI技术的发展,UI设计与开发之间的界限变得越来越模糊。上述工具各自有着独特的定位和优势,无论是专业的设计团队还是个人开发者,都能找到最适合自己的解决方案。Figma依然是专业设计团队的最佳选择;而对于追求速度和效率的快速原型开发,或是非专业人士,v0、bolt.new和Lovable等AI驱动的工具则提供了更多的可能性。选择正确的工具,可以让您的设计和开发过程更加流畅高效。