目录

- 1. 下载安装Ollama

- 2. 环境配置

- - 关闭开机自启动(可选):

- - 配置环境变量(必须):

- - 配置端口(可选):

- - 允许浏览器跨域请求(可选):

- 3. 运行Ollama

1. 下载安装Ollama

Ollama主页:https://ollama.com/ ,支持macOS, Linux 和 Windows 系统,点击下载按钮,获取OllamaSetup.exe安装程序。

双击安装文件,点击「Install」开始安装。目前的Ollama会默认安装到C盘,路径如下:C:\Users\%username%\AppData\Local\Programs\Ollama,并不会让用户自定义选择安装路径。

安装完成后,会在电脑右下角出现Ollama图标,可以不用先启动Ollama,先退出做一些必要路径的配置!

右键图标,会出现退出的按钮「Quit Ollama」,注意:一定要退出Ollama,否则下边的环境配置无法生效!

2. 环境配置

- 关闭开机自启动(可选):

Ollama 默认会随 Windows 自动启动,可以在「文件资源管理器」的地址栏中访问以下路径,删除其中的Ollama.lnk快捷方式文件,阻止它自动启动。

%APPDATA%\Microsoft\Windows\Start Menu\Programs\Startup

- 配置环境变量(必须):

Ollama 的默认模型存储路径如下:C:\Users\%username%\.ollama\models,无论 C 盘空间大小,需要安装多少模型,都建议换一个存放路径到其它盘,否则会影响电脑运行速度。

打开「系统环境变量」,新建一个系统变量OLLAMA_MODELS ,然后设置ollama模型的存储路径。

变量名:OLLAMA_MODELS

变量值(路径):D:\Work\ollama\models

- 配置端口(可选):

Ollama API 的默认访问地址和侦听端口是http://localhost:11434,只能在装有 Ollama 的系统中直接调用。如果要在网络中提供服务,请修改 API 的侦听地址和端口(在系统环境变量里设置):

变量名:OLLAMA_HOST

变量值(端口)::8000

只填写端口号可以同时侦听(所有) IPv4 和 IPv6 的:8000 端口。(变量值的端口前号前有个冒号:)

注:要使用 IPv6,需要 Ollama 0.0.20 或更高版本。另外,可能需要在 Windows 防火墙中开放相应端口的远程访问。

- 允许浏览器跨域请求(可选):

Ollama 默认只允许来自127.0.0.1和0.0.0.0的跨域请求,如果你计划在其它前端面板中调用 Ollama API,比如Open WebUI,建议放开跨域限制:

变量名:OLLAMA_ORIGINS

变量值:*

3. 运行Ollama

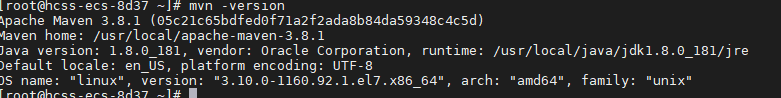

将上述更改的环境变量保存后,在「开始」菜单中找到并重新启动 Ollama。找到ollama.exe的所在位置,在该位置打开cmd

执行指令ollama run <模型名称>,首次执行会从模型库中下载模型,所需时间取决于你的网速和模型大小。模型库地址:https://ollama.org.cn/library

等待下载模型完成后,就可以使用了:

如果觉得直接在黑框里运行不优雅,可以将Ollama接入到成熟的UI系统中,比如Open WebUI,地址如下:

https://github.com/ollama/ollama?tab=readme-ov-file#community-integrations