第42周:文献阅读

目录

摘要

Abstract

文献阅读

问题引入

研究背景

研究意义

研究目的

相关工作

基于泛锐化的HMIF方法

基于分解的HMIF 方法

基于深度学习的HMIF 方法

隐式神经表示

创新点

隐式 Transformer

连续函数捕捉特征

引导隐式神经采样模块

结合生成对抗框架

方法论

生成器网络

判别器网络

损失函数

实验研究

数据集

实验结果

结果分析

光谱和PSNR曲线对比分析

成分分析

消融实验

总结

摘要

这篇文献围绕高光谱和多光谱遥感图像融合展开,结构上按引言、相关工作、方法、实验、结论的顺序逐步深入,逻辑严谨。它的独特之处在于将隐式神经表示与Transformer结合,提出ITF - GAN方法。该方法优势显著,能有效利用图像信息,克服传统和现有深度学习方法的缺陷。其应用于提升高光谱遥感图像空间分辨率,这是因为实际中环境监测、土地分类等领域对兼具高空间和高光谱分辨率的数据需求迫切。实验结果显示,在多个数据集上,ITF - GAN在融合效果上,无论是客观指标还是主观视觉评价都优于其他对比方法,光谱保真度表现尤为突出。但ITF - GAN因Transformer架构存在计算强度大、内存需求高的问题,未来需设计更轻量高效的注意力机制来改进。总之,ITF - GAN为遥感图像融合提供了新方案,虽有待完善,但已展现出良好的应用前景与研究价值。

Abstract

This literature focuses on the fusion of hyperspectral and multispectral remote sensing images, gradually deepening in the order of introduction, related work, methods, experiments, and conclusions, with rigorous logic. Its uniqueness lies in combining implicit neural representation with Transformer and proposing the ITF-GAN method. This method has significant advantages in effectively utilizing image information and overcoming the shortcomings of traditional and existing deep learning methods. It is applied to enhance the spatial resolution of hyperspectral remote sensing images, as there is an urgent demand for data with both high spatial and spectral resolution in fields such as environmental monitoring and land classification. The experimental results show that on multiple datasets, ITF-GAN outperforms other comparison methods in both objective and subjective visual evaluations in terms of fusion performance, with particularly outstanding spectral fidelity. However, due to the high computational intensity and memory requirements of Transformer architecture, ITF-GAN needs to design lighter and more efficient attention mechanisms to improve in the future. In summary, ITF-GAN provides a new solution for remote sensing image fusion, which needs improvement but has shown good application prospects and research value.

文献阅读

title:An Implicit Transformer-based Fusion Method for Hyperspectral and Multispectral Remote Sensing Image

https://doi.org/10.1016/j.jag.2024.103955

问题引入

研究背景

高光谱遥感图像(HSI)因其丰富的光谱分辨率高,但空间分辨率低。相比之下,多光谱遥感图像(MSI)虽空间分辨率高,但光谱分辨率较低。实际应用中对高空间和高光谱分辨率图像的需求促使了图像融合技术的发展,通过融合不同传感器获取的同一场景数据,提取有利信息并重建高空间分辨率的高光谱遥感图像(HR-HSI),以满足环境监测、土地分类和灾害检测等领域的需求。

研究意义

通过融合高光谱和多光谱图像,生成高空间分辨率和高光谱分辨率的图像,显著提升了图像质量,满足实际应用中对高质量图像的需求。同时,首次将隐式神经表示与变换器架构相结合,为高光谱和多光谱图像融合提供了新的技术思路,推动了相关技术的发展。

研究目的

旨在开发一种基于隐式变换器的融合生成对抗网络(ITF-GAN),以提升高光谱和多光谱图像融合的效果,克服现有融合技术在空间细节保真度和光谱信息完整性方面的局限性。

相关工作

基于泛锐化的HMIF方法

pansharpening一种新的全色锐化训练框架,该框架结合了监督和无监督学习,解决了基于监督学习方法在全分辨率和降低分辨率域性能差异的问题。

成分替代(CS)方法和多分辨率分析(MRA)方法是传统的高光谱图像和多光谱图像融合(HMIF)技术。

CS方法通过将低空间分辨率图像上采样到高空间分辨率,分离空间和光谱信息,用高空间分辨率图像的相应部分替换空间信息,最后通过逆变换重建融合图像。

MRA方法对图像执行多分辨率变换,提取低频和高频分量,并将高频信息注入低空间分辨率图像中。

基于分解的HMIF 方法

基于分解的高光谱和多光谱图像融合(Decomposition-based HMIF)方法通过将图像分解为光谱基和系数的乘积形式来实现图像融合,包括矩阵分解和张量分解两个子类。

矩阵分解将图像分解为二维矩阵,可能会丢失一些信息,因为它将本质上三维的高光谱图像和多光谱图像转换为二维矩阵。

张量分解是将图像表示为三维张量的方法,与矩阵分解相比,它可以保留图像每个维度的独特特征。

基于深度学习的HMIF 方法

基于深度学习的高光谱和多光谱图像融合(Deep Learning-based HMIF)方法利用深度神经网络的强大非线性拟合能力,通过无监督和监督学习两种途径实现图像融合。

无监督学习不依赖于训练数据,直接将待融合的高光谱图像(HSI)和多光谱图像(MSI)作为输入,通过网络优化获得高分辨率的高光谱图像(HR-HSI)。无监督方法在融合过程中计算参数众多,导致效率较低。

监督学习涉及训练以拟合数据间非线性映射。根据特征提取方法,分为单分支和双分支网络。 深度学习方法可能需要一些时间成本进行参数调整,但训练好的模型通常可以更有效地进行图像融合。

隐式神经表示

隐式神经表示(Implicit Neural Representation,INR)是一种新兴的深度学习方法,。这种方法通过学习输入数据的隐式函数,能够生成复杂的数据分布,并且具有更强的泛化能力。

创新点

隐式 Transformer

首次将隐式 Transformer 应用于高光谱和多光谱图像融合(HMIF),通过坐标计算注意力矩阵,有效整合图像的空间和光谱信息,提升融合效果。

连续函数捕捉特征

利用连续可微函数替代离散感知方法,更贴合人类视觉对场景的连续表达,增强了融合图像的表达能力和质量。

引导隐式神经采样模块

在高光谱图像上采样过程中,引入引导隐式神经采样(GINS)模块,利用多光谱信息引导上采样,有效整合多模态图像信息,提升空间细节表达。

结合生成对抗框架

运用生成对抗网络(GAN)框架,通过判别器优化对抗损失,促使生成器生成更逼真的图像,增强融合图像的空间和光谱细节。

方法论

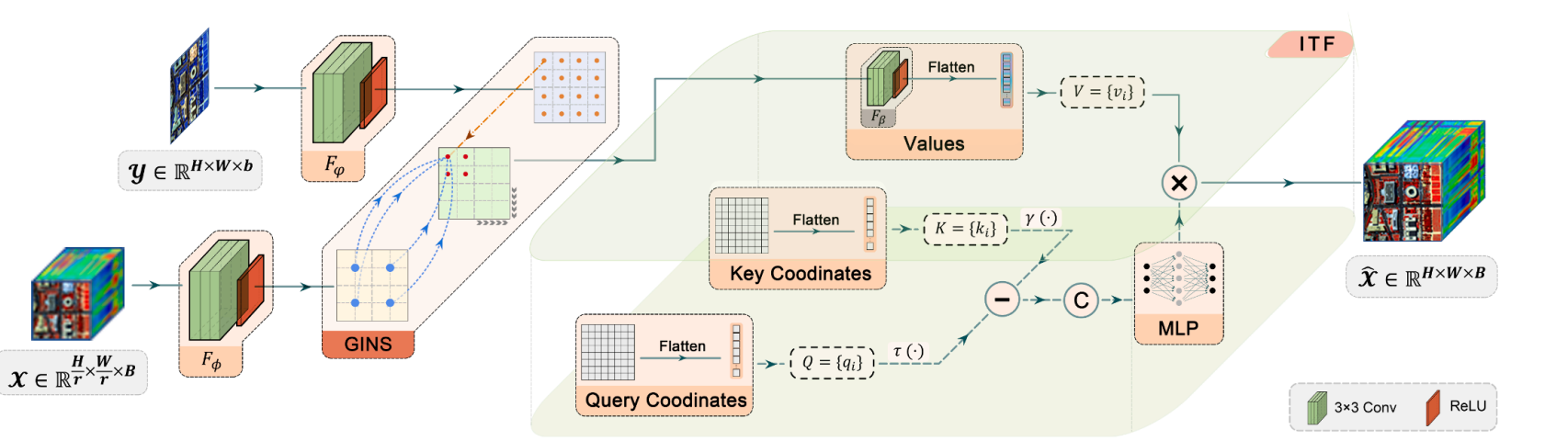

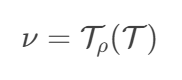

生成器网络

step1 通过特征提取网络从输入图像中提取特征

step2 利用GINS模块进行隐式上采样以生成初步融合结果

step3 通过ITF模块进一步整合特征生成高质量的融合图像

ITF模块(Implicit Transformer Fusion module)是用于图像融合的深度学习模型的一部分,它利用隐式神经表示和Transformer架构中的自注意力机制来处理图像数据。设计目标是在图像融合过程中有效地整合空间和光谱信息,以生成具有高空间分辨率和光谱保真度的融合图像。

1)预编码模块

主要用于对输入的高光谱图像(HSI)和多光谱图像(MSI)进行

step1 浅层特征提取和编码(并行卷积层处理),

step2 使其映射到相同的特征空间(特征统一化)。

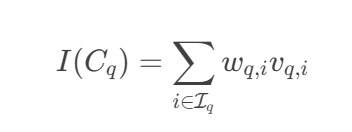

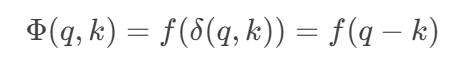

2)引导隐式神经采样

引导采样指的是使用一种图像(如多光谱图像MSI)来指导另一种图像(如高光谱图像HSI)的上采样过程。

隐式映射是一种使用连续可微分函数来映射输入(如坐标)到输出(如图像像素值)。

主要用于解决传统上采样方法(如双线性或双三次插值)在空间-光谱特征保留不足的问题。

它通过隐式神经表示(INR)和多光谱图像(MSI)引导,实现高光谱图像(HSI)的高质量连续上采样,提升融合结果的空间细节和光谱保真度。

step1 引导隐式上采样

利用高分辨率作为引导,对低分辨率的特征进行逐点隐式插值

step2 动态权重计算

权重通过多层感知机(MLP)和Softmax生成,基于坐标偏移和特征相似性自适应调整

step3 坐标连续映射

将图像归一化到一个指定区间

3)隐式变压器融合模块

将隐式神经表示(INR)与Transformer架构结合用于HSI和MSI融合

step1 特征编码

使用卷积对GINS输出的初步融合结果进行编码

step2 隐式注意力计算

transformer代替矩阵乘法——>MLP实现连续投影——>注意力输出

step3 光谱预测

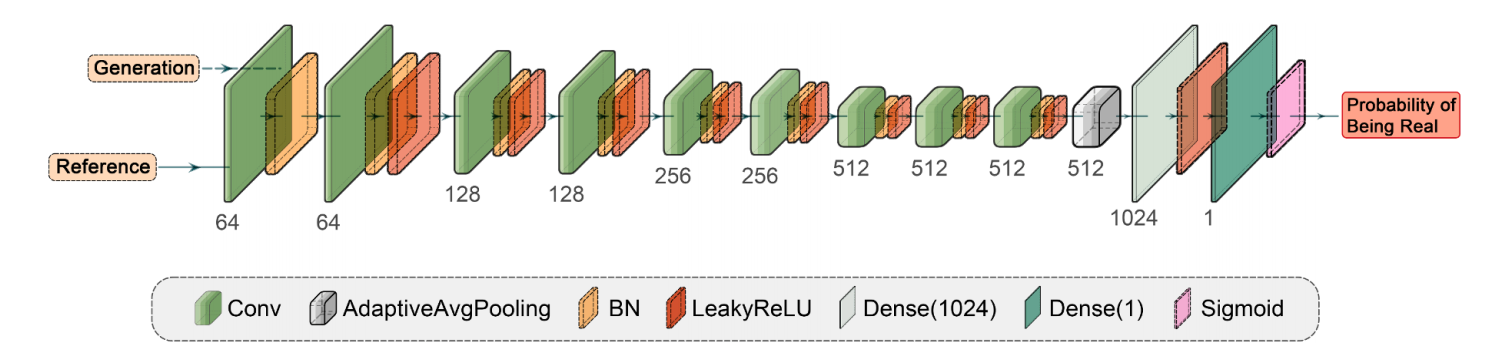

判别器网络

判别器接收生成图像和参考图像作为输入,并通过一系列卷积层(Conv)、批归一化层(BN)、LeakyReLU激活函数和自适应平均池化层(AdaptiveAvgPooling)提取特征,随后通过全连接层(Dense)处理这些特征,最终使用Sigmoid激活函数输出图像为真实图像的概率。

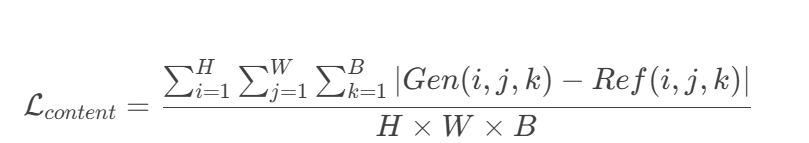

损失函数

1)内容损失

采用L1损失,对异常值更鲁棒,能更好保留图像边缘和细节

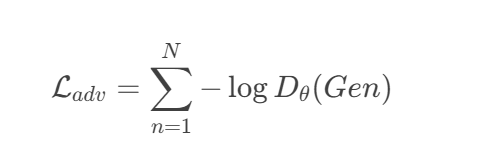

2)对抗损失

采用Sigmoid输出的二元交叉熵

总的损失就是对两个损失进行加权求和。

实验研究

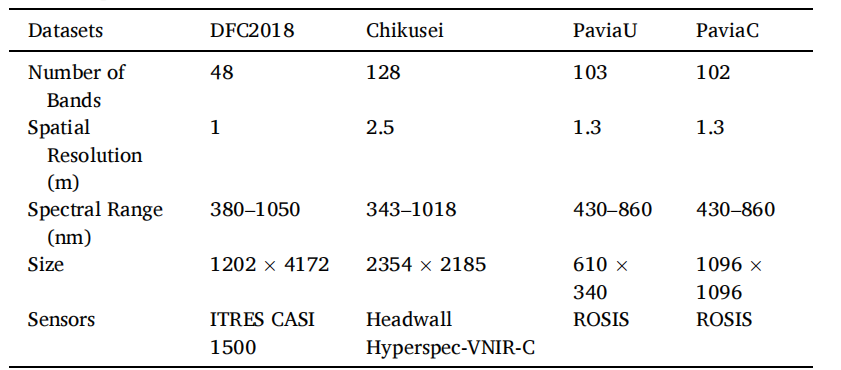

数据集

ITF-GAN在四个多源遥感数据集上进行了综合验证,这些数据集覆盖了不同传感器类型、空间分辨率和光谱特性,包含城市、校园和农业等多类场景。 这种多样化的数据选择和严格的数据处理有效验证了ITF-GAN在不同数据分布下的泛化性和鲁棒性。

实验结果

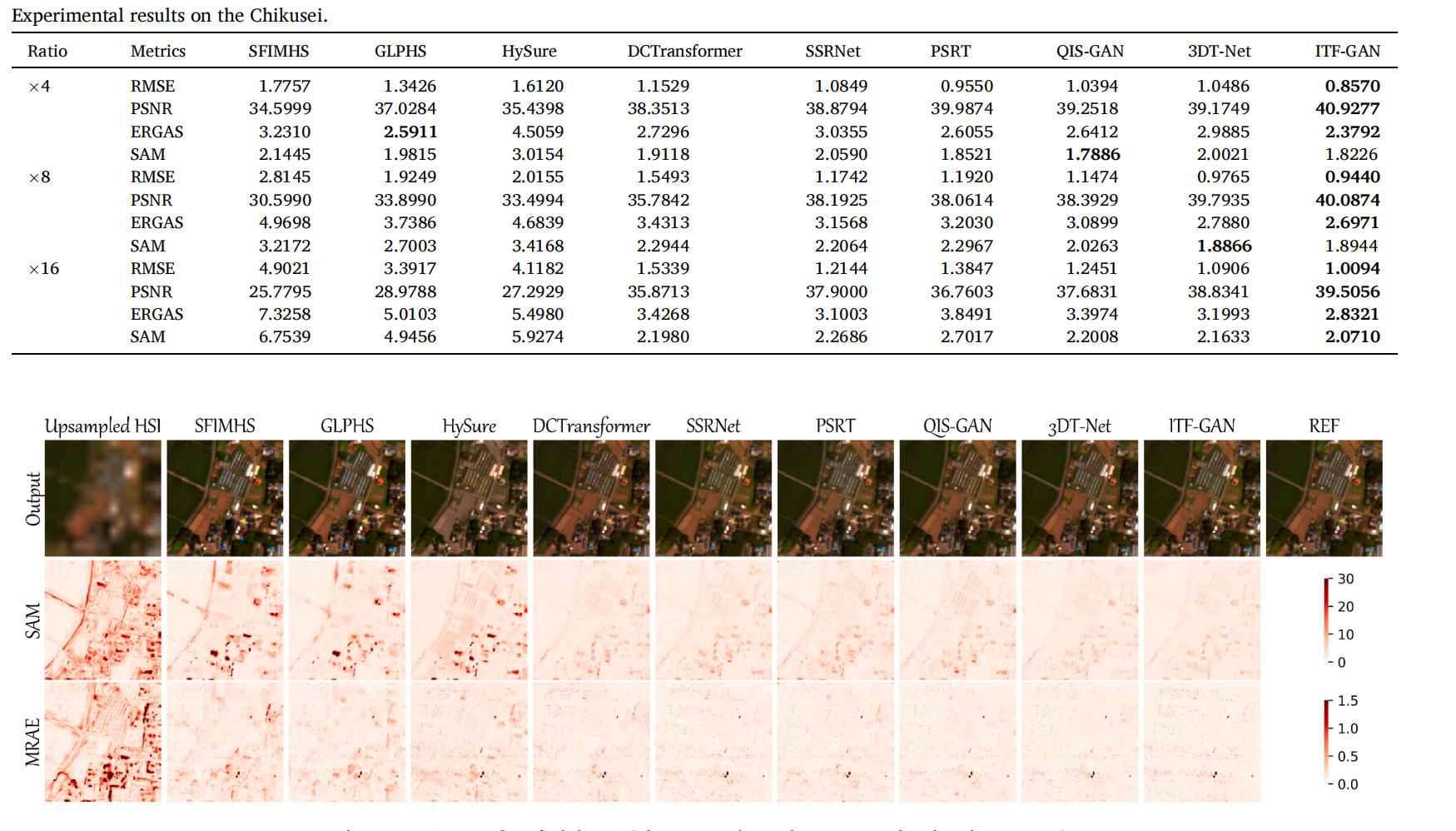

进行了多尺度的评估,以及热力图对比,下面以Chikusei数据集为例:

(其余三个数据集都表现出同样的状态)

1、客观表格数据来看,ITF-GAN 在所有数据集和尺度因子下均取得最优或接近最优结果

2、主观热力图图像来看,ITF-GAN 的融合结果最接近参考图像,细节更清晰,伪影更少。

3、在不同数据集上看,高光谱分辨率(Chikusei) 和 高空间分辨率(DFC2018) 数据中均表现稳定,适应不同传感器特性。 说明其鲁棒性比较强。

结果分析

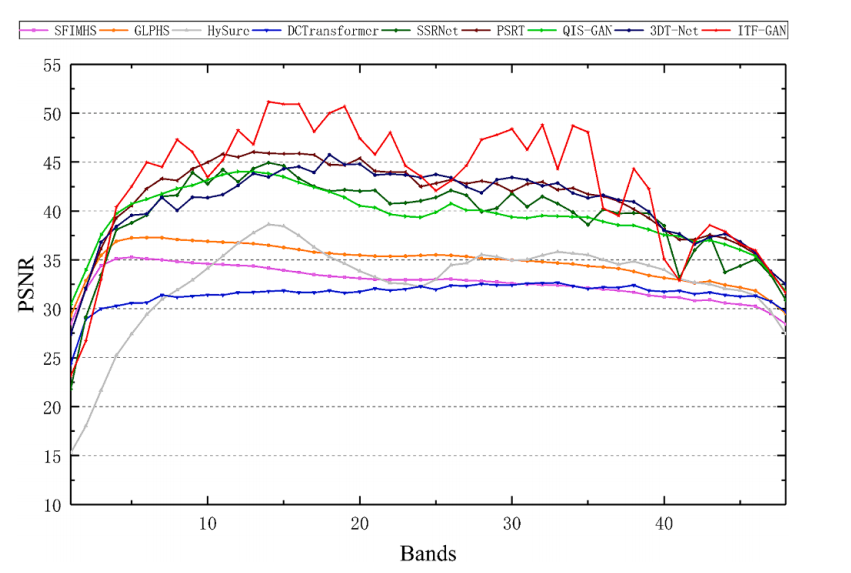

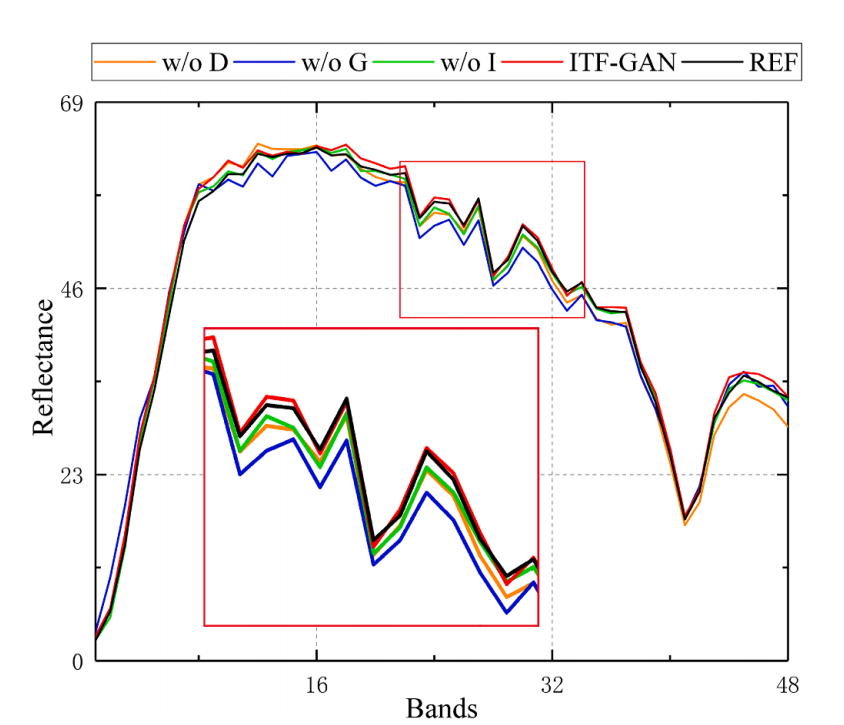

光谱和PSNR曲线对比分析

PSNR曲线(Peak Signal-to-Noise Ratio),是一种用于评估图像质量的指标,特别是在图像融合、增强和压缩等领域。PSNR是衡量图像中信号最大值(通常指峰值,即图像中最亮的部分)与背景噪声之间的比值。

评判标准:

PSNR值越高,图像质量越好;曲线越平滑,表示该方法在不同波段上的性能越稳定,没有大的波动,这通常意味着该方法能更一致地保持图像质量。

结论分析:

直观反映了ITF-GAN在PSNR指标上的全面优势,验证了其隐式Transformer和GINS模块的设计有效性,同时凸显了深度学习相比传统方法的性能代差。

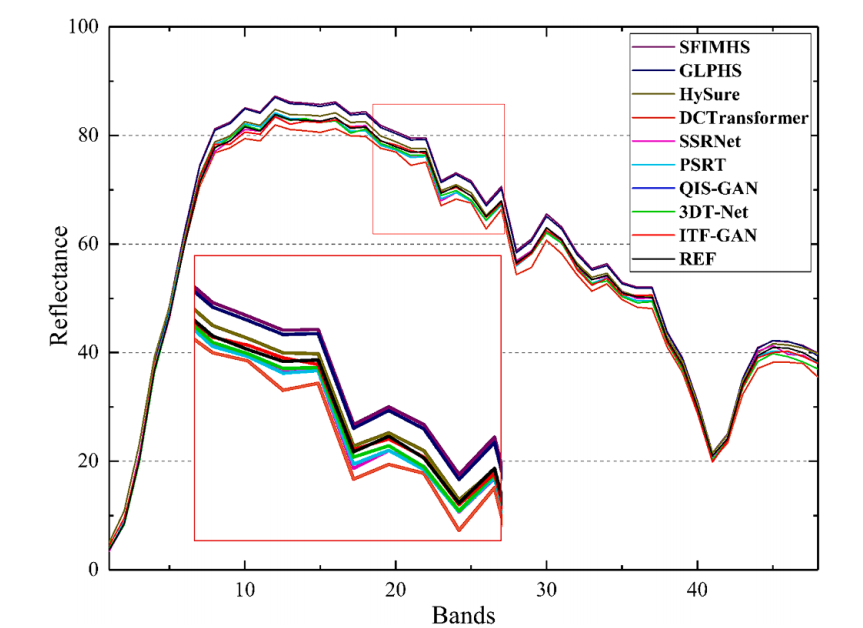

光谱保真度分析也是一种评估图像质量的指标,它关注的是处理后图像的光谱信息是否仍然接近原始图像,即是否能够准确反映地物的真实光谱特性。

评判标准:

曲线越接近真实数据的参考曲线,说明该方法的光谱保真度越高,性能越好;曲线越是光滑且连续,这表明融合方法能够较好地保留图像的光谱特性

结论分析:

ITF-GAN在大多数波段上表现优异,显示出其在保持高光谱保真度方面的优势。

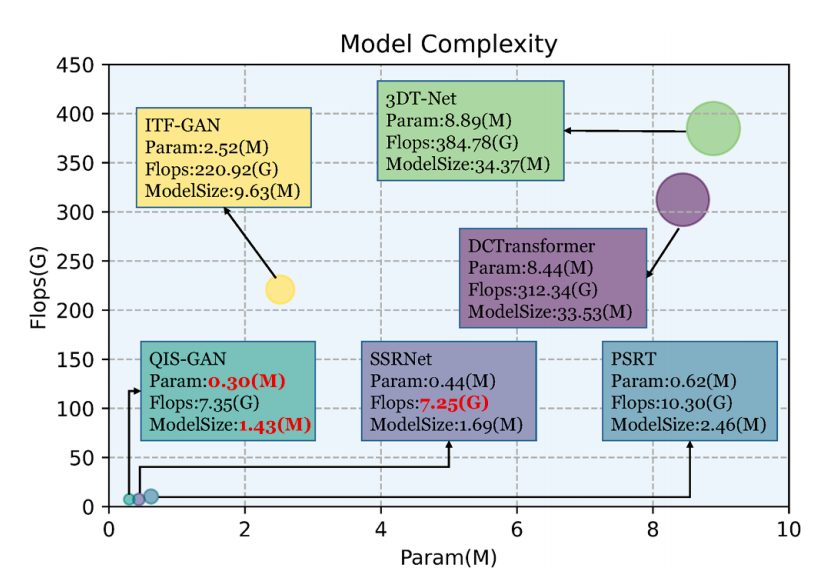

成分分析

通过三个关键指标来比较不同图像融合模型的复杂度:参数数量(Param)、浮点运算次数(Flops)和模型大小(Model Size)。这些指标用于评估模型的计算需求和存储需求,从而了解模型的资源消耗和潜在的运行效率。

可以看出,本文提出的ITF-GAN模型在参数数量、Flops和模型大小方面都相对较高,表明其计算复杂度较高,可能提供更好的性能,但也需要更多的计算资源。与其正好相反的是QIS-GAN,所有指标上都较低,表明其计算和存储需求都较低,可能在资源受限的环境中表现更好。

得到启发:

1、可结合QIS-GAN的隐式采样与ITF-GAN的注意力机制,进一步优化计算效率。

2、高复杂度模型需依赖GPU集群

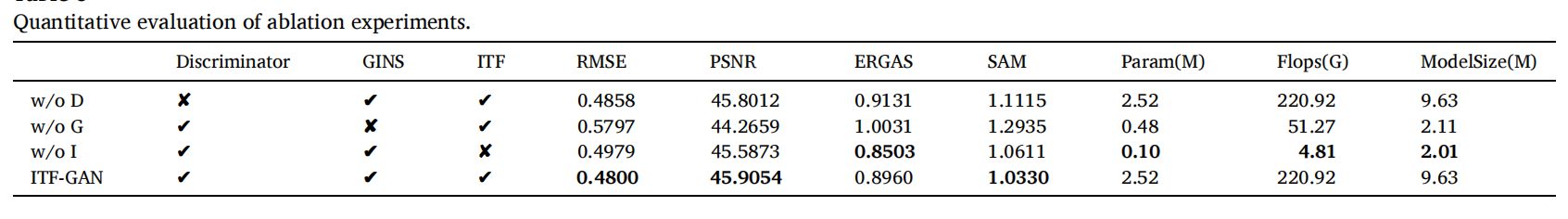

消融实验

为探究 ITF - GAN 各组件对高光谱和多光谱图像融合(HMIF)的作用,在 DFC2018 数据集上以 4x 尺度因子融合开展消融实验,分别去掉引导隐式神经采样(GINS)模块、隐式 Transformer(ITF)模块和判别器网络。

结论分析:

GINS模块

解决传统上采样的空间信息丢失问题,是大尺度融合性能保障的核心

消融后RMSE上升20.7%,复杂度降低76%

ITF模块

通过隐式注意力机制实现像素级光谱保真,移除后SAM上升2.7%

计算成本高,需进一步轻量化(如稀疏注意力)

判别器

对抗损失提升视觉真实性,但对客观指标(如PSNR)影响较小(仅-0.1dB)

总结

文献提出ITF-GAN模型用于高光谱和多光谱遥感图像融合,创新性融合隐式神经表示与Transformer架构,通过引导隐式神经采样等模块提升融合质量。实验表明该模型在多个数据集上的融合效果优于传统及现有深度学习方法,尤其在光谱保真度上表现出色,可满足环境监测等领域对高分辨率图像的需求。除了阅读该文献之外,还学习了其中的引导隐式神经采样是什么,以及具体步骤,并且学习了GAN在图像融合方面的结合应用。