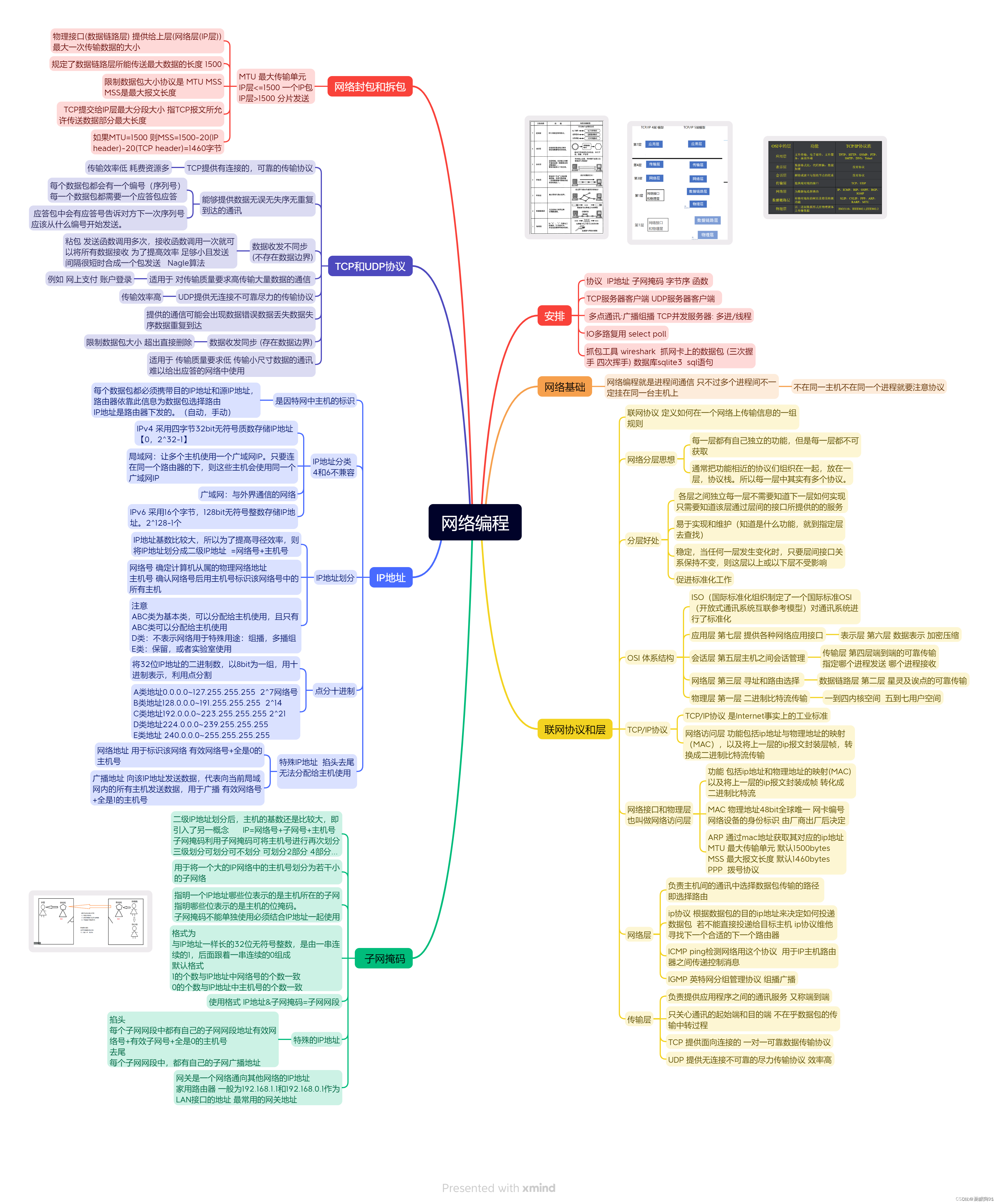

网络编程脑图

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.xdnf.cn/news/149886.html

如若内容造成侵权/违法违规/事实不符,请联系一条长河网进行投诉反馈,一经查实,立即删除!相关文章

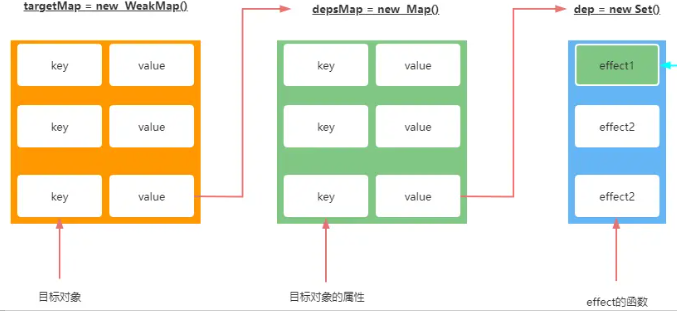

源码上分析Vue2和Vue3的响应式原理

本文节选自我的博客:源码上分析Vue2和Vue3的响应式原理 💖 作者简介:大家好,我是MilesChen,偏前端的全栈开发者。📝 CSDN主页:爱吃糖的猫🔥📣 我的博客:爱吃糖…

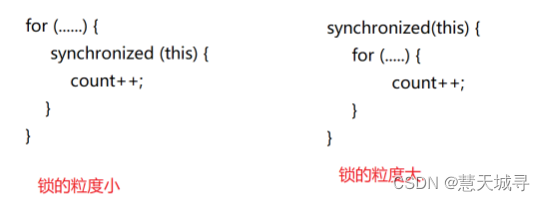

【多线程进阶】synchronized 原理

文章目录 前言1. 基本锁策略2. 加锁工作过程2.1 偏向锁2.2 轻量级锁2.3 重量级锁 3. 其他的优化操作3.1 锁消除3.2 锁粗化 总结 前言

在前面章节中, 提到了多线程中的锁策略, 那么我们 Java 中的锁 synchronized 背后都采取了哪些锁策略呢? 又是如何进行工作的呢? 本节我们就…

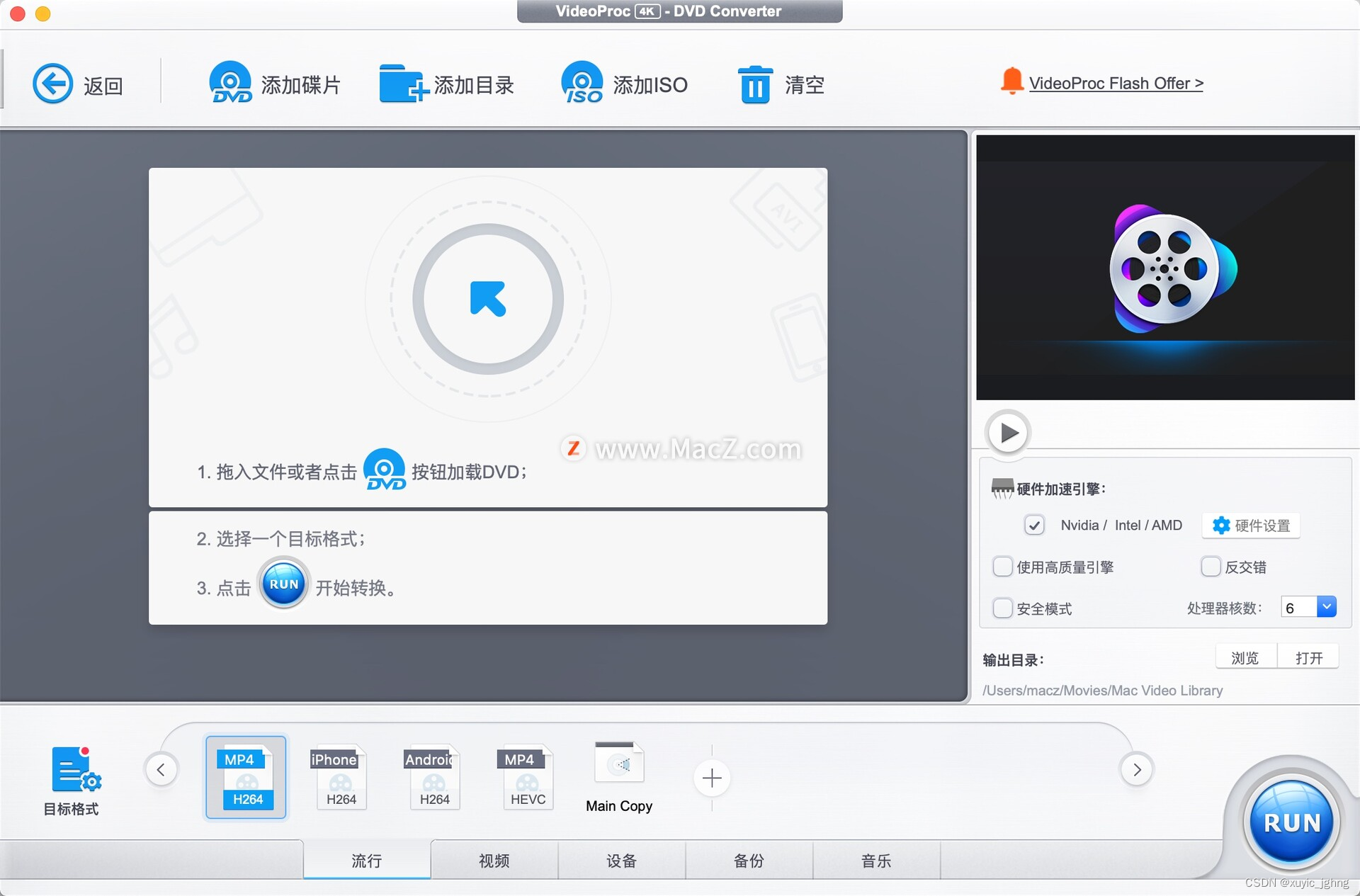

全能视频工具 VideoProc Converter 4K for mac中文

VideoProc 4K提供快速完备的4K影片处理方案,您可以透过这款软体调节输出影片格式和大小。能够有效压缩HD/4K影片体积90%以上,以便更好更快地上传到YouTube,或是通过电子邮件附件发送。业界领先的视讯压缩引擎,让你轻松处理大体积视…

《Attention Is All You Need》论文笔记

下面是对《Attention Is All You Need》这篇论文的浅读。

参考文献:

李沐论文带读

HarvardNLP

《哈工大基于预训练模型的方法》

下面是对这篇论文的初步概览:

对Seq2Seq模型、Transformer的概括:

下面是蒟蒻在阅读完这篇论文后做的一…

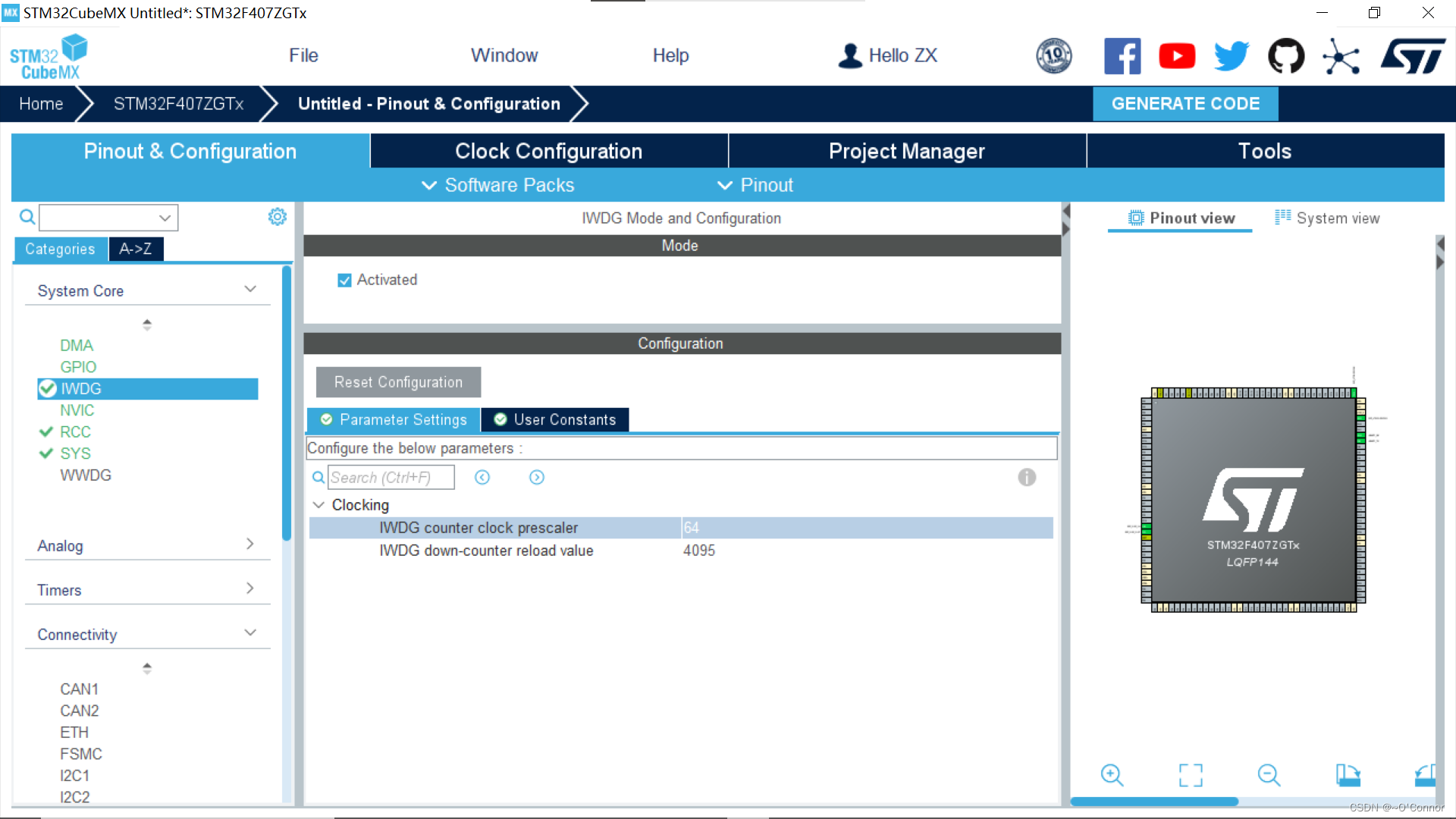

STM32复习笔记(四):看门狗

目录

(一)简介

(二)IWDG

IWDG的CUBEMX工程配置

IWDG相关函数(非常少,所以直接贴上来):

(三)WWDG (一)简介

看门狗分为独立看门…

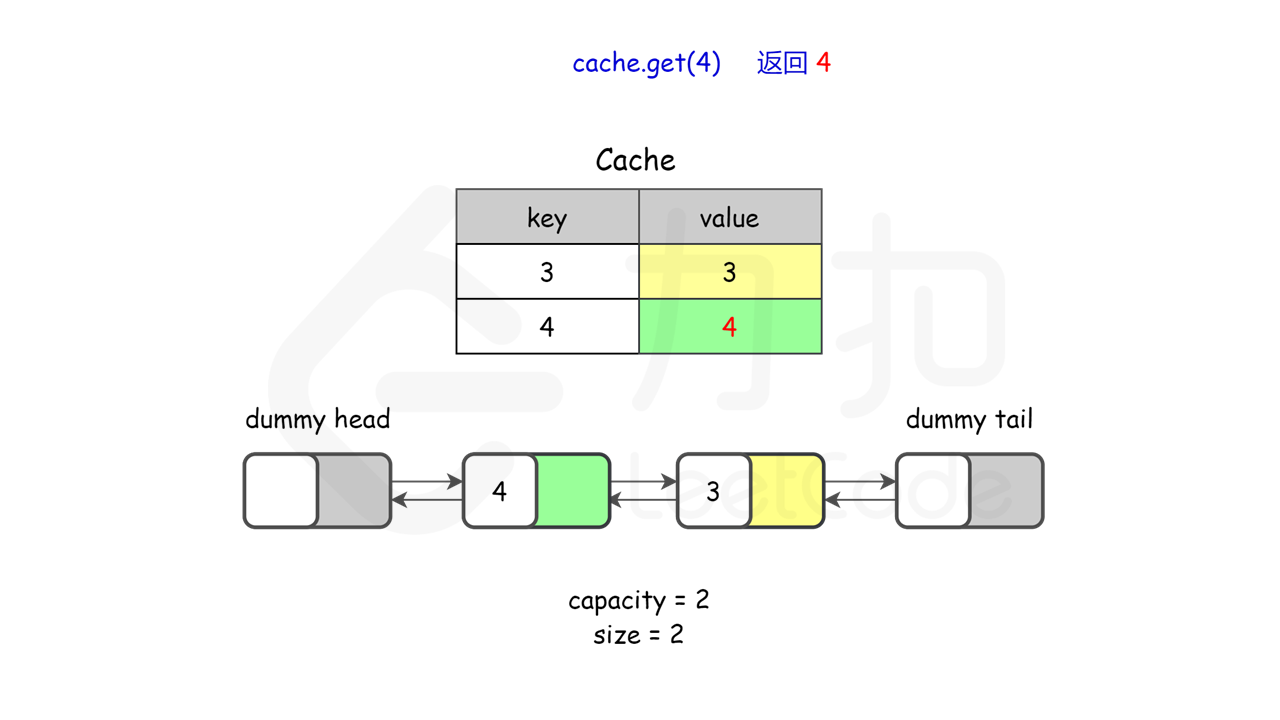

第三课 哈希表、集合、映射

文章目录 第三课 哈希表、集合、映射lc1.两数之和--简单题目描述代码展示 lc30.串联所有单词的子串--困难题目描述代码展示 lc49.字母异位分组--中等题目描述代码展示 lc874.模拟行走机器人--中等题目描述代码展示 lc146.LRU缓存--中等题目描述相关补充思路讲解代码展示图示理解…

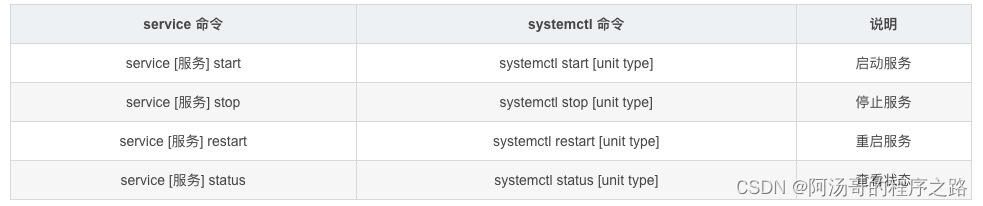

mysql双主互从通过KeepAlived虚拟IP实现高可用

mysql双主互从通过KeepAlived虚拟IP实现高可用

在mysql 双主互从的基础上, 架构图: Keepalived有两个主要的功能:

提供虚拟IP,实现双机热备通过LVS,实现负载均衡

安装

# 安装

yum -y install keepalived

# 卸载

…

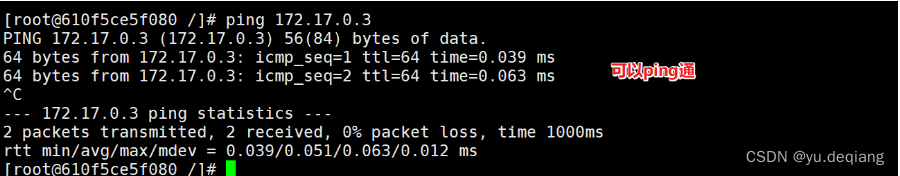

【docker】数据卷和数据卷容器

一、如何管理docker容器中的数据? 二、数据卷

1、数据卷原理

将容器内部的配置文件目录,挂载到宿主机指定目录下

数据卷默认会一直存在,即使容器被删除 宿主机和容器是两个不同的名称空间,如果想进行连接需要用ssh,…

vue、vuex状态管理、vuex的核心概念state状态

每一个 Vuex 应用的核心就是 store(仓库)。“store”基本上就是一个容器,它包含着你的应用中大部分的状态 (state)。Vuex 和单纯的全局对象有以下两点不同: Vuex 的状态存储是响应式的。当 Vue 组件从 store 中读取状态的时候&…

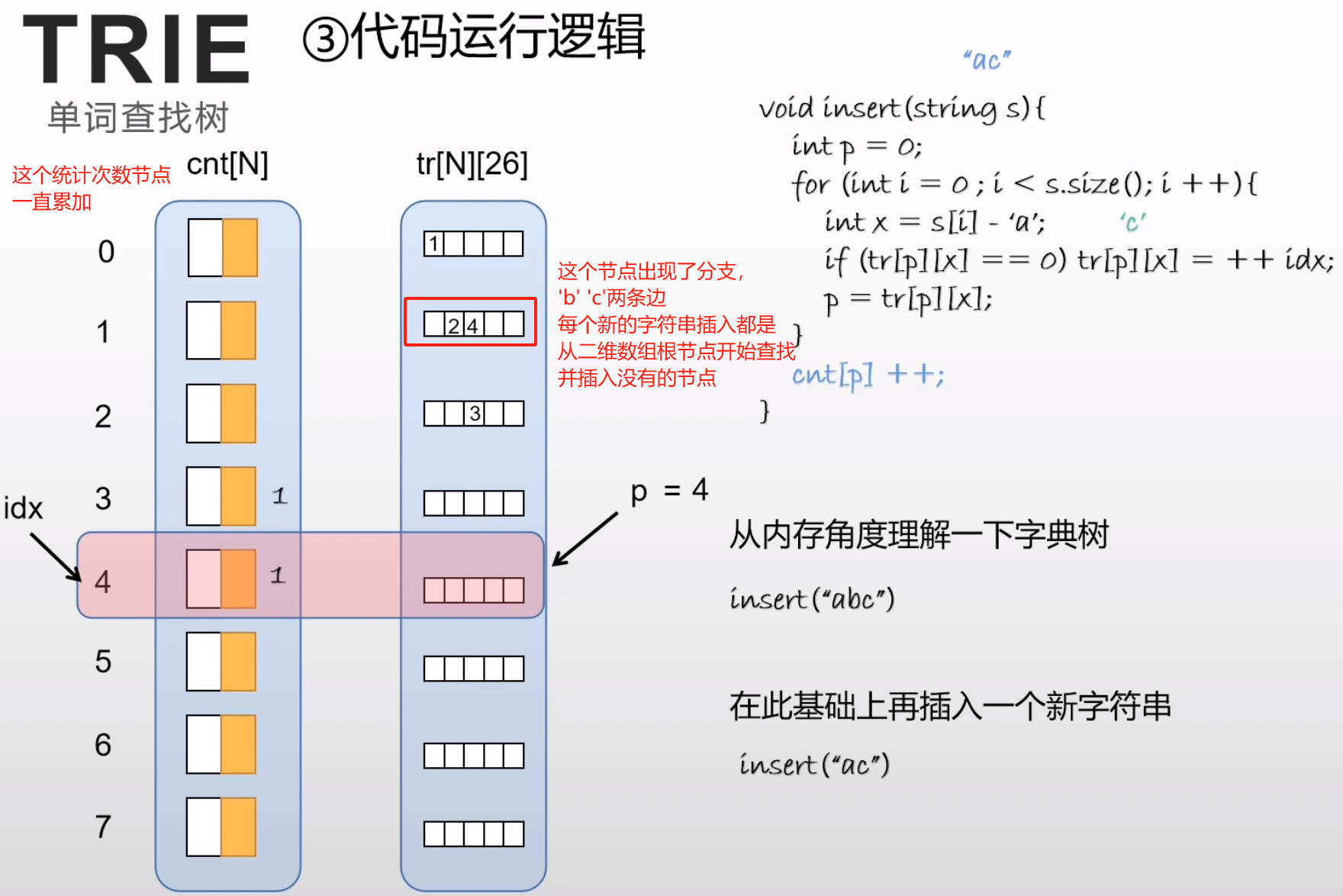

数据结构--Trie字符串统计

1、“Trie树” 作用:

高效地存储和查找字符串集合的数据结构。

2、“Trie树” 存储字符串的形式如下: 用 “0” 来表示 “根节点(root)”。存入一个字符串时,会在字符串最后结尾的那个字符节点打上标记。比如&#x…

投资理财:利率下行时代应该怎样存钱?

大家好,我是财富智星,今天跟大家分享一下当下利率下行的时代,钱应该怎样存,存哪里的问题。 一、 银行利率下行 在过去的三十年里,您已经逐渐适应了不断下降的利率,从10%到现在的1.65%。而在未来,…

迄今为止丨ChatGPT最强指令,一个可以让机器人生成机器人的Prompt,价值百万!

原文:

【ChatGPT调教】ChatGPT最强指令、让机器人为你生成机器人!-CSDN博客

说明:最好看原文

昨天,发现了一条可能是迄今为止,我见过最牛的,商业价值最高的ChatGPT指令。

通过这条指令,可以…

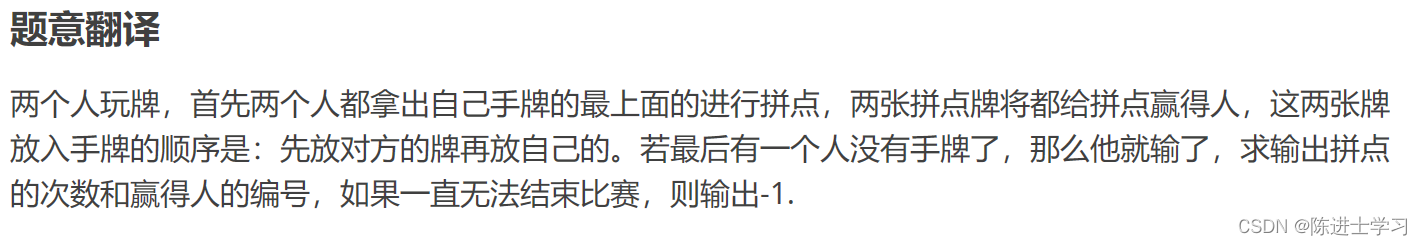

1400*C. Soldier and Cards(贪心模拟)

Problem - 546C - Codeforces

Soldier and Cards - 洛谷 解析: 模拟即可,当循环次数过大的时候跳出循环打印 -1

#include<bits/stdc.h>

using namespace std;

#define int long long

const int N2e55;

int n,x,k1,k2,cnt;

queue<int>a,b;…

[黑马程序员TypeScript笔记]------一篇就够了

目录:

TypeScript 介绍 TypeScript 是什么?TypeScript 为什么要为 JS 添加类型支持?TypeScript 相比 JS 的优势TypeScript 初体验 安装编译 TS 的工具包 编译并运行 TS 代码 简化运行 TS 的步骤 TypeScript 常用类型 概述类型注解常用基础…

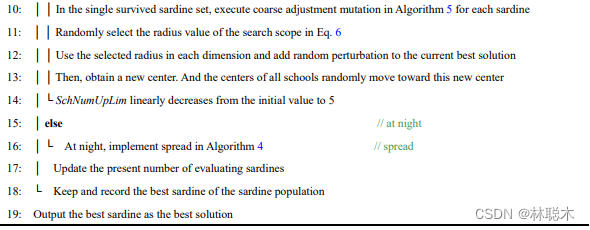

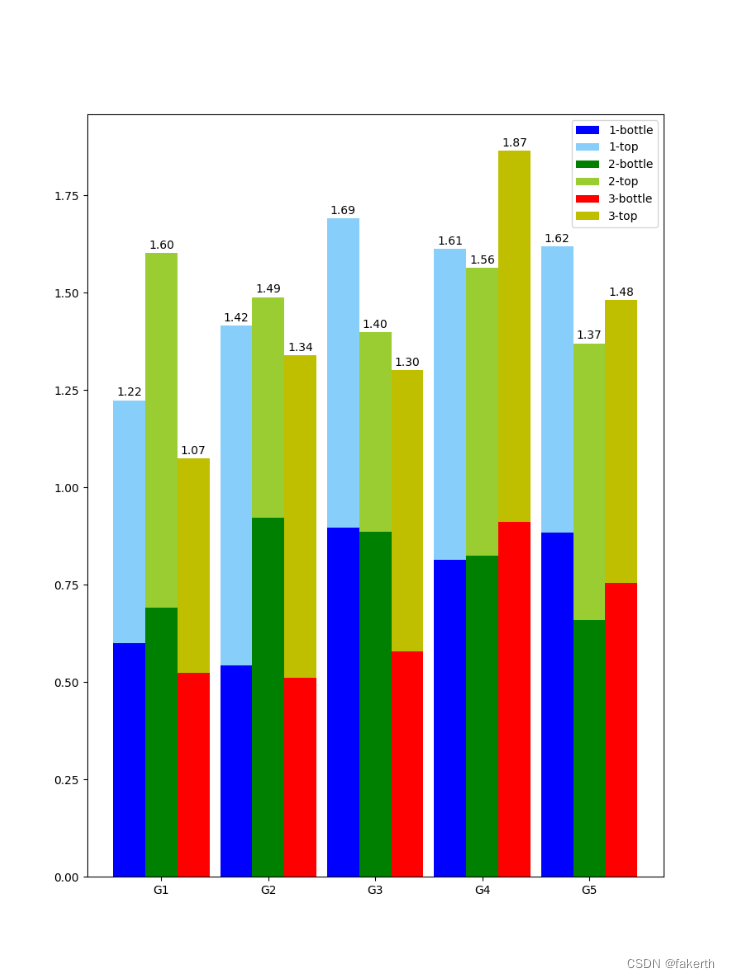

MATLAB算法实战应用案例精讲-【优化算法】沙丁鱼优化算法(SOA)(附MATLAB代码实现)

前言

沙丁鱼优化算法(Sardine optimization algorithm,SOA)由Zhang HongGuang等人于2023年提出,该算法模拟沙丁鱼的生存策略,具有搜索能力强,求解精度高等特点。

沙丁鱼主要以浮游生物为食,这些生物包括细菌、腔肠动物、软体动物、原生动物、十足目、幼小藤壶、鱼卵、甲藻…

LeetCode 面试题 08.02. 迷路的机器人

文章目录 一、题目二、C# 题解 一、题目 设想有个机器人坐在一个网格的左上角,网格 r 行 c 列。机器人只能向下或向右移动,但不能走到一些被禁止的网格(有障碍物)。设计一种算法,寻找机器人从左上角移动到右下角的路径…

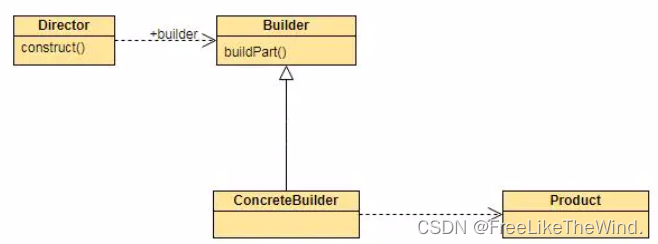

【C++设计模式之建造者模式:创建型】分析及示例

简介

建造者模式(Builder Pattern)是一种创建型设计模式,它将复杂对象的构建过程与其表示分离,使得同样的构建过程可以创建不同的表示。

描述

建造者模式通过将一个复杂对象的构建过程拆分成多个简单的部分,并由不同…

OpenGLES:绘制一个混色旋转的3D圆柱

效果展示

本篇博文会实现两种混色效果的3D圆柱: 一.圆柱体解析

上一篇博文讲解了怎么绘制一个混色旋转的立方体

这一篇讲解怎么绘制一个混色旋转的圆柱

圆柱的顶点创建主要基于2D圆进行扩展,与立方体没有相似之处

圆柱绘制的关键点就是将圆柱拆解成…

【TensorFlow Hub】:有 100 个预训练模型等你用

要访问TensorFlow Hub,请单击此处 — https://www.tensorflow.org/hub 一、说明 TensorFlow Hub是一个库,用于在TensorFlow中发布,发现和使用可重用模型。它提供了一种使用预训练模型执行各种任务(如图像分类、文本分析等…

最新文章

- Paddle Inplace 使用指南

- 国产T630 USB3.0 P2P替换 CYUSB3014,USB3.0通道工业相机,医疗高清成像

- 始于情怀,终于品质----方寸微T630 USB3.0 替换 CYUSB3014

- 对WinMain的理解

- EtherCAT主站SOEM -- 44 -- win-vs-soem-win10及win11系统VisualStudio-SOEM-控制电机走周期同步位置模式(CSP模式)

- linux安装binutils

- Vue使用axios实现Ajax请求

- List几种遍历方法速度

- Java中的事务管理:编程式与声明式事务的对比与应用

- 等保测评:企业如何建立安全的开发环境

- 计算机毕业设计 基于Python的医疗预约与诊断系统 Django+Vue 前后端分离 附源码 讲解 文档

- python数学运算符

- 并发编程。

- 日丰卫浴启动国货好物节,以“焕新+公益+体验”筑国民美好生活

- 常见统计量与其抽样分布

- 【2024W37】肖恩技术周刊(第 15 期):中秋节快乐

- 微服务——配置管理

- 同等学力英语历年真题有必要做吗

![[黑马程序员TypeScript笔记]------一篇就够了](https://img-blog.csdnimg.cn/0f044f450122461cb43c393334a4ce0e.png)