文章目录

- 1.背景

- 2.基本概念

- 2.1 CephFS IO流程

- 2.2 Ceph-FUSE

- 3. 问题

- 3.1 问题源起

- 3.2 理论分析

- 3.3 原因排查

- 3.3.1 Ceph-FUSE日志分析

- 3.3.2 提出猜想

- 3.3.3 代码验证

- 3.3.3.1 MDS端

- 3.3.3.2 Ceph-FUSE端

- 3.4 小结

1.背景

随着大数据、人工智能技术的蓬勃发展,人类对于算力资源的需求也迎来大幅度的增长。在某平台以降本增效为目标,整合了公司的GPU训练卡资源,为算法工程师们提供统一的底层GPU算力服务。借助于虚拟化、算力挖掘等技术,平台服务公司内各BG的AI训练场景,GPU利用率业界领先。同时,通过云原生任务化的方式,对接了内部各大业务,促进了AI技术研究效率的提升和创新研究。

当下,由于AI训练时的高性能计算设备(如NVIDIA GPU)成本高昂,如果任务在训练过程中不能保证数据IO的速度,将会导致计算设备低载甚至空载,这无疑在时间和资源上都是一种极大的浪费。

在某平台内部,用户的训练数据大多存放在平台提供的CephFS中,训练时将对应的CephFS目录挂载至容器内部,从而使用户在训练时能够像使用本地文件系统一样使用CephFS。但在平台运营过程中我们发现,在训练数据集文件数较多时,训练任务使用CephFS会使训练速度变得异常缓慢。基于这个普遍存在的问题,本文剖析其产生的原理,然后介绍相应的优化方案。最后,通过延伸思考来发散思维,简要介绍了不同场景下AI训练加速的技术。

2.基本概念

2.1 CephFS IO流程

CephFS IO流程如下图所示。

当客户端进行文件系统调用时(如open、read、readdir等),需要先从元数据服务器(Metadata Server, MDS)中获取请求文件的元数据信息,元数据信息主要包括文件的Inode号、权限、uid、gid和访问更改时间等。为了加快元数据的访问效率,MDS将大部分热点元数据都缓存在自己的内存中,从而避免低效地通过访问RADOS(Reliable, Autonomic Distributed Object Store)层来获取元数据。客户端在从MDS中获取元数据后,通过计算的方式(CRUSH算法)得到数据在RADOS中的位置,最后与远程的存储设备进行交互。

从这个架构来看,CephFS是一个元数据和用户数据分离的文件系统。文件的元数据和数据存储在RADOS中的不同Pool中,客户端需要先与MDS进行元数据交互,再与RADOS进行数据交互。

2.2 Ceph-FUSE

Ceph-FUSE是CephFS客户端的一种形式,通过用户空间文件系统(Filesystem in Userspace, FUSE)的方式来实现CephFS客户端的功能。FUSE是一个面向类Unix计算机操作系统的软件接口,它使无特权的用户能够无需编辑内核代码而创建自己的文件系统。目前Linux通过内核模块对此进行支持。通过这种方式,我们可以编写用户态的应用程序,只需要实现Linux定义的一组文件系统接口,即可在用户态实现一个完整的文件系统。

当用户需要与CephFS进行交互时,客户端的整个IO流程如下:

- 用户程序通过syscall或glibc库进行系统调用。

- 进程陷入内核态,文件系统操作请求到达Linux虚拟文件系统(Virtual Filesystem, VFS)。

- VFS根据请求类型,从Dentry Cache、Inode Cache和Page Cache中分别查找dentry、inode和页缓存,若缓存命中可直接返回。

- 若缓存不命中,则将请求转发至FUSE Driver。

- Ceph-FUSE进程通过libfuse监听到来自于/dev/fuse的请求,与Ceph集群进行交互并返回结果。

当用户态程序发起FUSE请求时,Ceph-FUSE在经过处理后会将元数据信息缓存在内存中,提升后续访问的性能。同时,Linux的Dentry Cache、Inode Cache和Page Cache也会分别缓存该文件的dentry、inode和页,提升热点数据的读取性能。

3. 问题

3.1 问题源起

平台上运行的训练任务场景各不相同。在运营过程中我们发现,有用户反映某些任务中CephFS的读取速度较慢,使整个训练的时间拉长,其中属CV(Computer Vision)类的任务较为明显。

平台上CV类的任务数据集,一般都是海量的图片文件。这类数据集的特点是:

- 文件个数多,小数据集达到十万级别,大数据集达到百万、千万甚至上亿级别。

- 单个文件占用空间不大,大多是小文件。

3.2 理论分析

AI训练场景与许多复杂的文件操作场景不同,其数据读写的逻辑较为简单。一般来说,用户会在每个epoch训练相同的数据,然后训练多个epoch直至模型达到收敛条件。因此,AI训练场景下,训练文件在训练过程中保持不变,且被读取的频率相对固定,同时写文件的频率较低。

针对这种特点,由于Ceph-FUSE会对访问过的元数据进行缓存,同时Linux的Dentry Cache、Inode Cache和Page Cache也会充分缓存读取过的文件元数据和文件数据。通常来说,在第二个epoch开始时,由于数据集文件在第一个epoch已被访问过,训练时的IO速度应当有非常明显的提升。然而,事与愿违,对于较多数量的文件,我们发现训练速度没有明显提升,且每个epoch的训练速度都很慢。

为了查出其中的原因,接下来我们复制一个一模一样的任务,打开Ceph-FUSE日志进行分析。

3.3 原因排查

3.3.1 Ceph-FUSE日志分析

在训练任务开始时,打开母机上的Ceph-FUSE日志进行查看。

疑点现象:

- 在第一个epoch接近末尾时,发现出现了日志trim_caps mds.x max xxx caps xxx。

- 每次trim_caps执行,清除的dentry个数为5000。

- 该日志每隔5s会打印一次,往后的训练过程中会一直持续。

注:CAPS是指capabilities,MDS用CAPS授予客户端对不同文件进行操作的许可,因此MDS需要实时维护每个客户端文件操作的CAPS。这就意味着,如果客户端持有了某个文件的CAPS并进行了缓存,MDS需要知道每个客户端缓存了哪些文件。

3.3.2 提出猜想

根据疑点现象大概能够提出以下的猜想:

- 在第一个epoch结束时发生了trim_caps现象,且多次测试结果均是如此,猜测可能是缓存数量到达了某个阈值。

- 日志每隔5s会打印一次,可能是定时器触发了trim_caps。

- MDS需要维护每个客户端的CAPS,当客户端读取文件数较多时,MDS的cache总会达到oversize的状态,必定会触发trim_caps。

3.3.3 代码验证

根据上述猜想,可以在茫茫的Ceph源码中直奔主题,分别找出MDS和Ceph-FUSE的关键代码。

3.3.3.1 MDS端

根据现象2,在MDS中的tick函数内找到如下代码:

void MDSRankDispatcher::tick()

{......if (is_active() || is_stopping()) {server->recall_client_state(nullptr, Server::RecallFlags::ENFORCE_MAX); // 选中该MDS下持有较多caps数量的客户端,执行caps回收mdcache->trim();mdcache->trim_client_leases();mdcache->check_memory_usage(); // 当内存使用量过大时,选中该MDS下所有客户端,执行caps回收(recall_client_state)mdlog->trim();}......

}

从中可以看出,MDS端定时对客户端的CAPS进行回收,如果回收后内存使用量仍然过高,就对所有客户端再执行一次CAPS回收。在check_memory_usage函数中会根据cache试用情况决定是否再执行recall_client_state。

void MDCache::check_memory_usage()

{......if (cache_toofull()) {mds->server->recall_client_state(nullptr);}......

}

进入关键函数recall_client_state进行查看。

/*** Call this when the MDCache is oversized, to send requests to the clients* to trim some caps, and consequently unpin some inodes in the MDCache so* that it can trim too.*/

std::pair<bool, uint64_t> Server::recall_client_state(MDSGatherBuilder* gather, RecallFlags flags)

{......const bool enforce_max = flags&RecallFlags::ENFORCE_MAX;const auto max_caps_per_client = g_conf->get_val<uint64_t>("mds_max_caps_per_client"); // 默认为1_Mconst auto min_caps_per_client = g_conf->get_val<uint64_t>("mds_min_caps_per_client"); // 默认为100const auto recall_max_caps = g_conf->get_val<uint64_t>("mds_recall_max_caps"); // 默认为5000....../* trim caps of sessions with the most caps first */std::multimap<uint64_t, Session*> caps_session;auto f = [&caps_session, enforce_max, max_caps_per_client](Session* s) {auto num_caps = s->caps.size(); // 当前caps总量// 当flags为RecallFlags::ENFORCE_MAX时,只把caps数量超过max_caps_per_client的客户端找出来,否则找出所有客户端if (!enforce_max || num_caps > max_caps_per_client) {caps_session.emplace(std::piecewise_construct, std::forward_as_tuple(num_caps), std::forward_as_tuple(s));}};mds->sessionmap.get_client_sessions(std::move(f));......for (const auto p : boost::adaptors::reverse(caps_session)) {......// 计算每个客户端的最大caps数量uint64_t newlim;if (num_caps < recall_max_caps || (num_caps-recall_max_caps) < min_caps_per_client) {newlim = min_caps_per_client;} else {newlim = num_caps-recall_max_caps;}if (num_caps > newlim) {/* now limit the number of caps we recall at a time to prevent overloading ourselves */uint64_t recall = std::min<uint64_t>(recall_max_caps, num_caps-newlim); // 这里可以看出,每次最多回收mds_recall_max_caps个newlim = num_caps-recall;......auto m = new MClientSession(CEPH_SESSION_RECALL_STATE); // 新建一个类型为CEPH_SESSION_RECALL_STATE的请求m->head.max_caps = newlim; // 设置客户端的最大caps数量mds->send_message_client(m, session); // 向客户端发送请求......}......}......

}

从上述代码基本可以确定CAPS被清除的原因,MDS每隔5s执行了一次recall_client_state。由于mds_max_caps_per_client默认被设置为1_M(也就是1048576),当训练程序读取文件个数达到1_M后该客户端就会被加入caps_session队列发起CAPS回收请求。由于recall_max_caps默认被设置为5000,所以每次CAPS回收的个数为5000。

3.3.3.2 Ceph-FUSE端

首先,根据MDS端发起的类型为CEPH_SESSION_RECALL_STATE的请求,找到客户端接受请求的代码。

void Client::handle_client_session(MClientSession *m)

{......switch (m->get_op()) {......case CEPH_SESSION_RECALL_STATE:trim_caps(session, m->get_max_caps()); // max_caps,值为上述的newlimbreak;......}......

}

Ceph-FUSE接收到MDS的请求后,进入trim_caps函数。

void Client::trim_caps(MetaSession *s, uint64_t max)

{mds_rank_t mds = s->mds_num;size_t caps_size = s->caps.size(); // 客户端caps总量......uint64_t trimmed = 0;auto p = s->caps.begin();std::set<Dentry *> to_trim; // 将需要执行caps回收的Dentry放入其中等待回收// 以下内容通过迭代器p将caps清理至max以下,将需要清理的Dentry放入to_trim中while ((caps_size - trimmed) > max && !p.end()) {......}for (const auto &dn : to_trim) {trim_dentry(dn); // 执行Ceph-FUSE内的dentry缓存}to_trim.clear();caps_size = s->caps.size();if (caps_size > max)_invalidate_kernel_dcache(); // 这是关键函数,调用了Linux的remount操作来清理所有的dentries

Ceph-FUSE接收到MDS的请求后,会将CAPS总量清理至max以下(本例中就是清理5000个CAPS)。同时,将这些CAPS对应的dentry缓存全部清除,并调用操作系统命令来清除Dentry Cache、Inode Cache和Page Cache,执行命令为:

static int remount_cb(void *handle)

{// used for trimming kernel dcache. when remounting a file system, linux kernel// trims all unused dentries in the file systemchar cmd[1024];CephFuse::Handle *cfuse = (CephFuse::Handle *)handle;snprintf(cmd, sizeof(cmd), "mount -i -o remount %s", cfuse->opts.mountpoint); // 调用remount,清理文件系统的缓存int r = system(cmd);......

}

3.4 小结

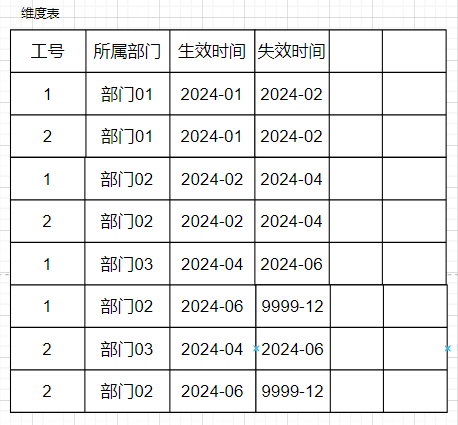

至此,基本真相大白。整体流程如下图所示:

训练程序启动,开始读取文件。

在第一个epoch训练后期,Ceph-FUSE拥有的CAPS达到1_M。

MDS定时器触发,对持有CAPS超过1_M的客户端执行发起回收CAPS请求,回收个数为5000。

Ceph-FUSE接收到CEPH_SESSION_RECALL_STATE请求,从caps队列中清除5000个CAPS并将这些CAPS对应的dentry从cache中清除。

Ceph-FUSE调用Linux的remount命令来清除Linux文件系统的cache。

MDS检查自身内存使用情况,若超过阈值则重复上述回收操作。

训练程序第二个epoch后,由于文件系统的cache被清除,导致缓存失效。