在几乎所有关于大型语言模型(LLM)的访谈中,总有一个问题反复出现:“部署 LLM 需要多少 GPU 内存?”

这个问题并非偶然,它是衡量您对这些强大模型在实际生产环境中部署和扩展能力理解程度的关键指标。

当您在处理像 GPT、LLaMA 或其他任何 LLM 时,准确估算所需的 GPU 内存至关重要。不论您面对的是7B参数的模型还是更大规模的模型,合理配置硬件资源以确保模型高效运行是不可忽视的环节。接下来,我们将深入解析相关计算,帮助您准确估算部署这些模型时所需的 GPU 内存。

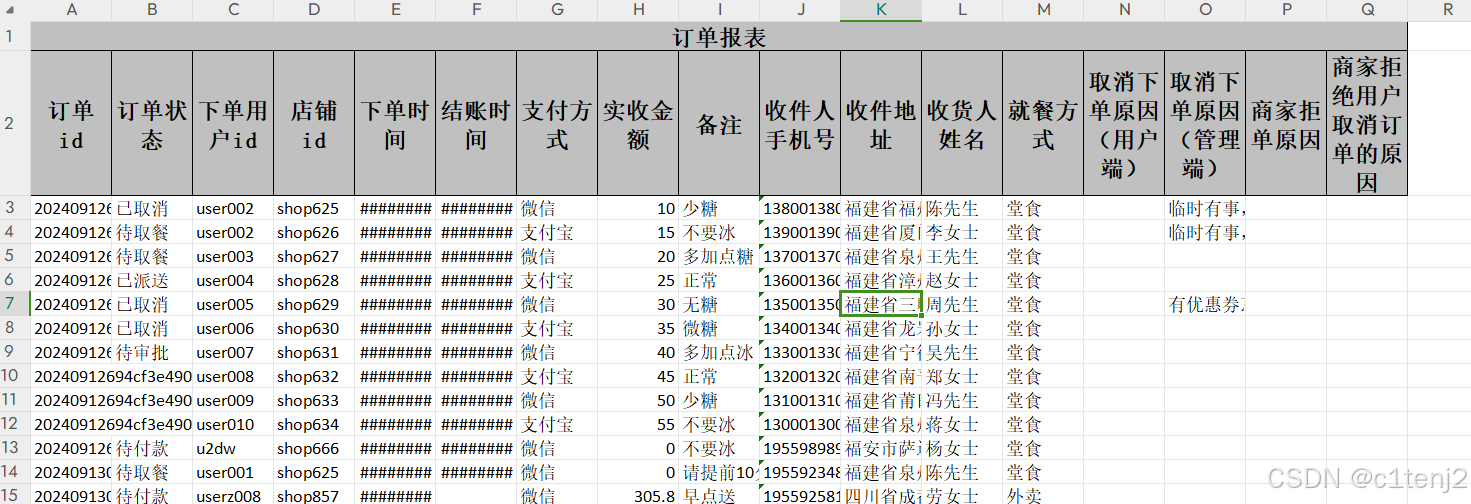

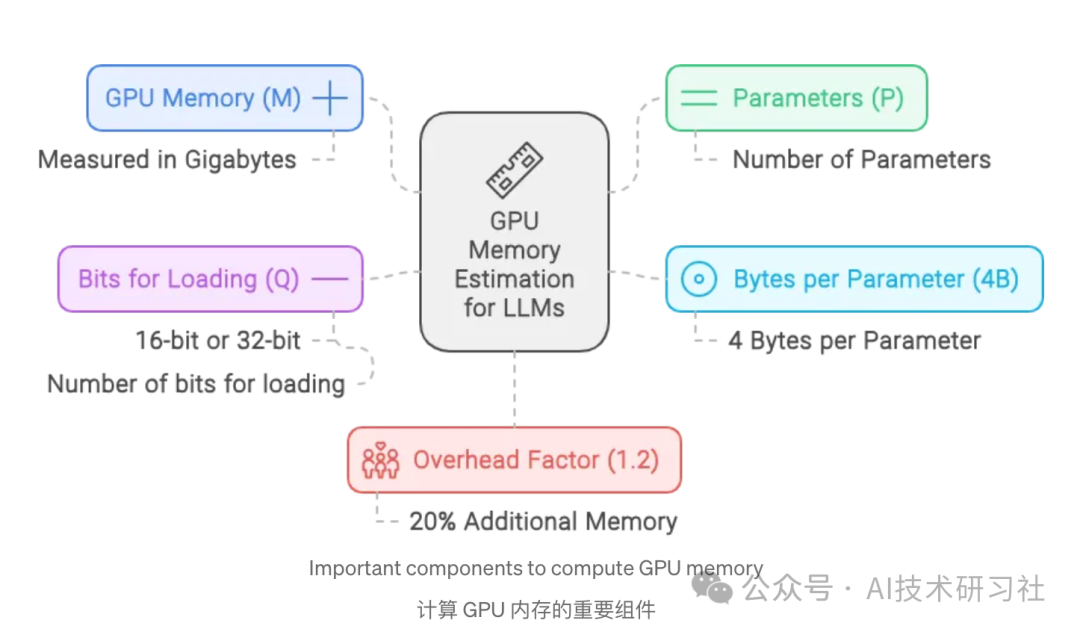

M 是 GPU 内存,以 GB 为单位。

P 是模型中的参数数。

4B 表示每个参数使用的 4 个字节(每个参数在内存中的占用)。

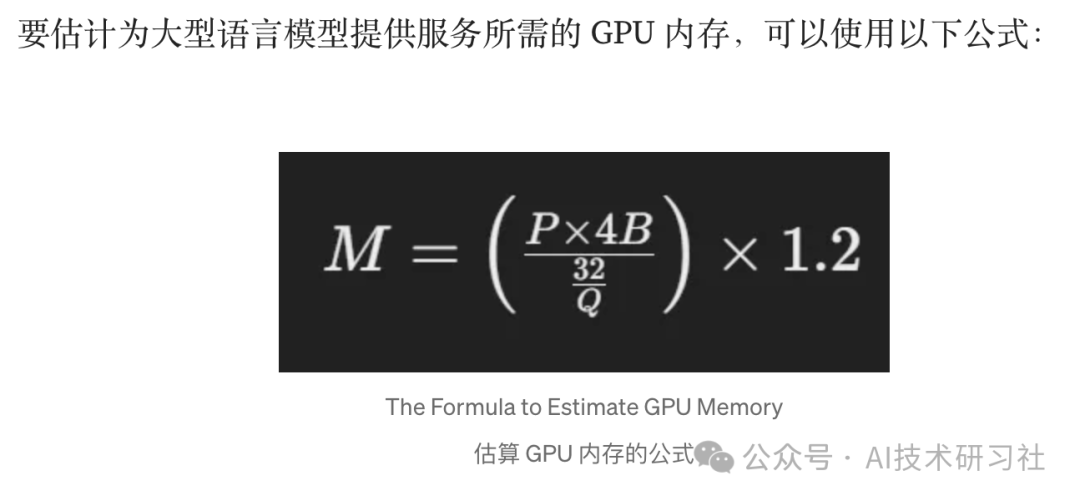

Q 是加载模型的位数(例如,16 位或 32 位)。

1.2 代表 20% 的额外开销,用于考虑额外的存储需求,例如缓存、元数据等。

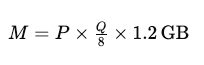

因此,公式可以表达为:

这个公式用于估算在部署大语言模型(LLM)时所需的 GPU 内存大小,确保模型可以顺利运行并考虑到一定的余量。

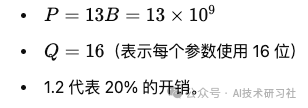

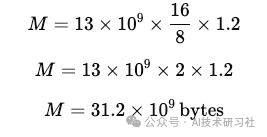

假设我们有一个模型,参数数量PPP 为 13B(130亿参数),使用 16 位(即 2 字节)来加载模型,想要估算部署这个模型所需的 GPU 内存MMM。

我们可以将这些值代入公式:

M=P×Q8×1.2

其中:

计算步骤如下:

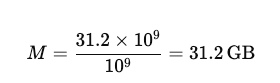

换算成 GB:

因此,部署这个 13B 参数、16 位精度的大模型大约需要 31.2 GB 的 GPU 内存。

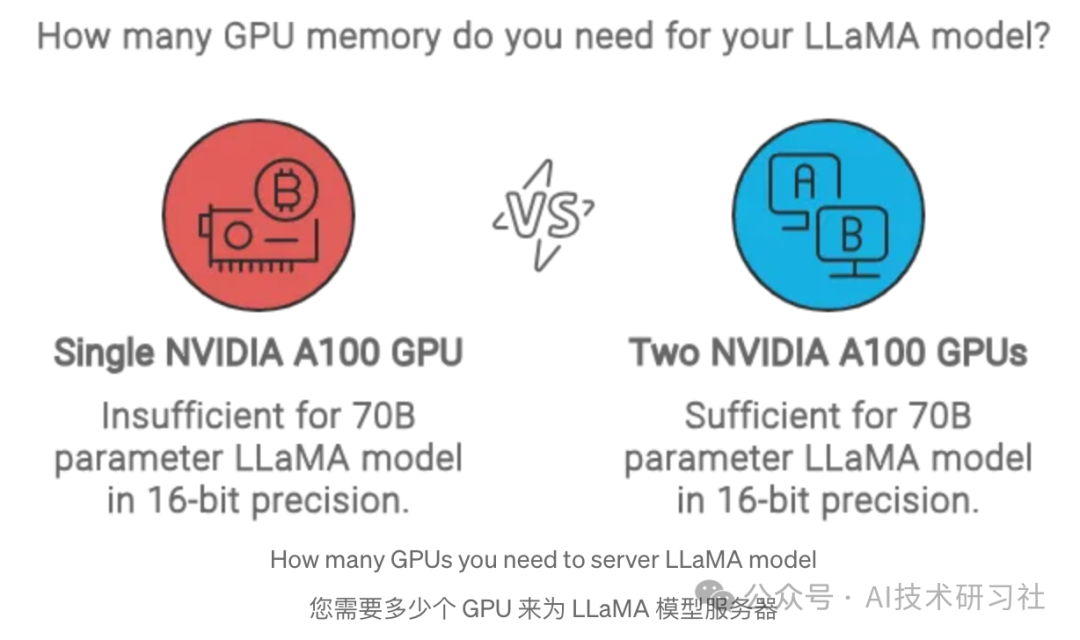

理解和应用这个公式不仅仅是理论上的;它具有现实世界的影响。例如,具有 80 GB 内存的单个 NVIDIA A100 GPU 不足以为该模型提供服务。您至少需要两个 A100 GPU,每个 GPU 为 80 GB,才能有效地处理内存负载。

通过掌握这一计算,您不仅能自信应对面试中的关键问题,更能在实际部署中避免硬件资源的高昂浪费。下次评估 LLM 部署时,您将精准了解如何有效预估所需的 GPU 内存,确保系统高效运行,轻松应对挑战。

如何学习大模型

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

我已将重要的AI大模型资料包括市面上AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI大模型视频教程

三、AI大模型各大学习书籍

四、AI大模型各大场景实战案例

五、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。