Python爬虫详解

Python爬虫是一种用于从网站获取数据的自动化脚本。它使用Python编程语言编写,并利用各种库和模块来实现其功能。以下是Python爬虫的详细讲解,包括基本概念、常用库、基本流程和示例代码。

基本概念

- HTTP请求:爬虫通过向目标网站发送HTTP请求来获取页面内容。

- HTML解析:爬虫使用HTML解析库将获取到的页面内容解析为可用的数据结构。

- 数据提取:爬虫从解析后的页面中提取所需的数据,并将其存储在本地或发送到其他系统。

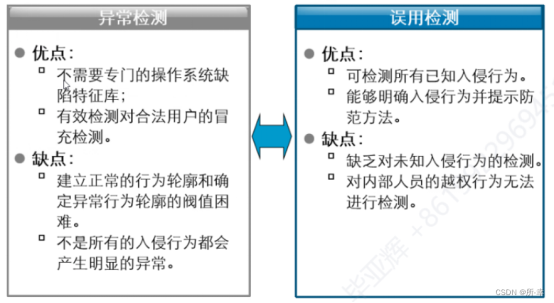

- 反爬虫机制:一些网站会采取措施来防止爬虫访问,例如限制请求频率、使用验证码等。

# HTTP请求

import requestsurl = 'https://www.example.com'

response = requests.get(url)

print(response.text)# HTML解析

from bs4 import BeautifulSouphtml_content = """

<html>

<body>

<h1>Hello, World!</h1>

</body>

</html>

"""

soup = BeautifulSoup(html_content, 'html.parser')

print(soup.h1.text)# 数据提取

data = {'name': 'John Doe','age': 30,'email': 'john.doe@example.com'

}

print(data['name'])# 反爬虫机制

import timedef get_page(url):response = requests.get(url)if 'robots' in response.headers['Content-Type']:print('反爬虫机制检测到,等待60秒')time.sleep(60)return get_page(url)return responseresponse = get_page(url)

print(response.text)常用库

总结

以上就是Python爬虫的详细讲解,包括基本概念、常用库、基本流程和示例代码。通过使用Python爬虫,您可以轻松地从网站获取所需的数据,并将其存储在本地或发送到其他系统进行进一步处理。在处理反爬虫机制时,您可以采取一些措施来绕过它们,例如使用代理、限制请求频率等。

- requests:用于发送HTTP请求。

- BeautifulSoup:用于解析HTML内容。

- Selenium:用于模拟浏览器行为,以绕过一些反爬虫机制。

- pandas:用于处理和存储提取到的数据。

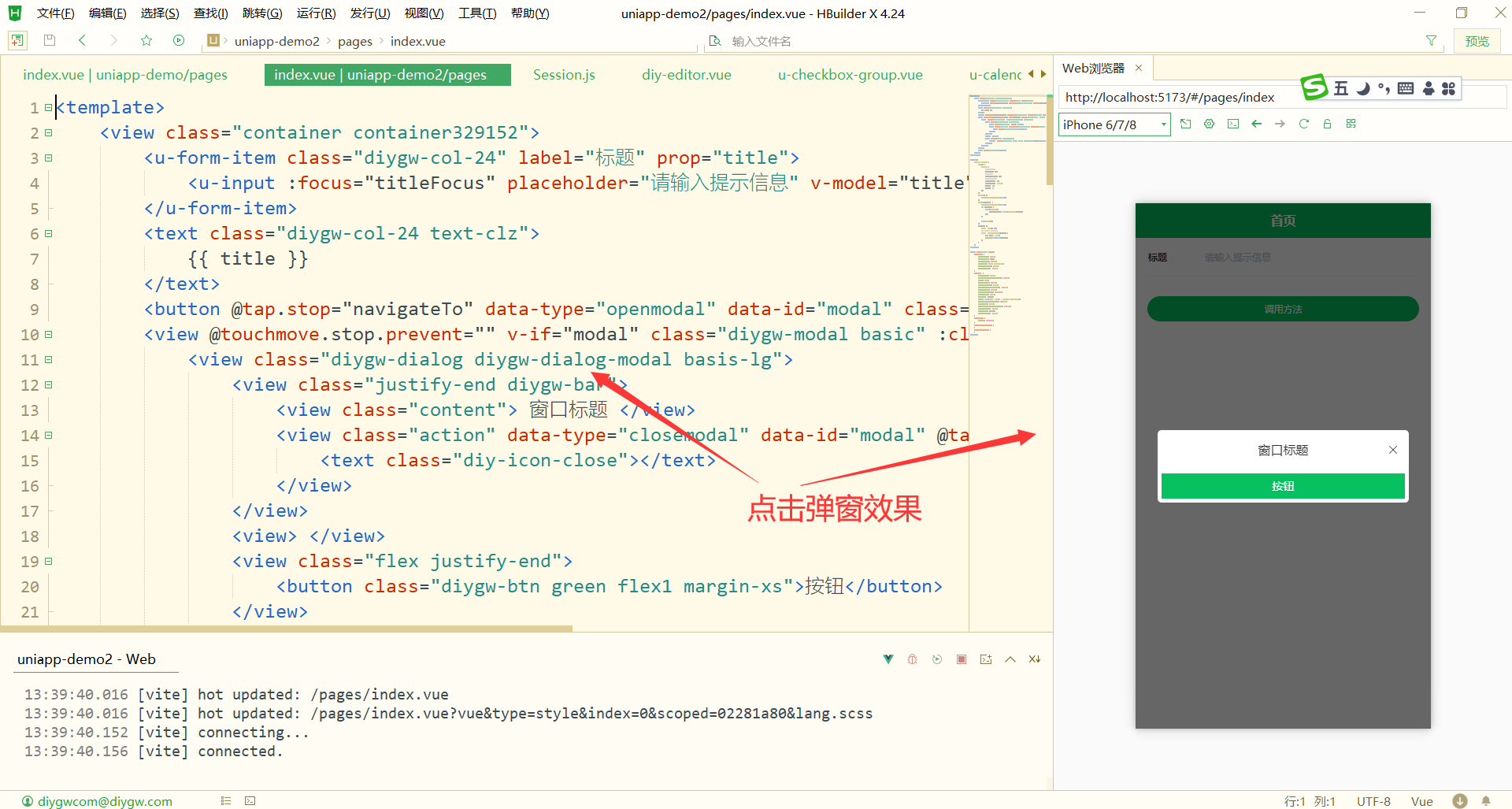

# requests库 import requestsurl = 'https://www.example.com' response = requests.get(url) print(response.text)# BeautifulSoup库 from bs4 import BeautifulSouphtml_content = """ <html> <body> <h1>Hello, World!</h1> </body> </html> """ soup = BeautifulSoup(html_content, 'html.parser') print(soup.h1.text)# Selenium库 from selenium import webdriverdriver = webdriver.Chrome() driver.get('https://www.example.com') print(driver.title) driver.quit()# pandas库 import pandas as pddata = {'name': ['John Doe', 'Jane Doe'],'age': [30, 25],'email': ['john.doe@example.com', 'jane.doe@example.com'] } df = pd.DataFrame(data) print(df)基本流程

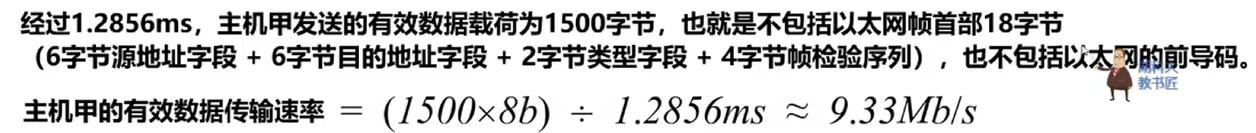

- 发送HTTP请求:使用

requests库向目标网站发送HTTP请求,获取页面内容。 - 解析HTML内容:使用

BeautifulSoup或lxml等库解析获取到的页面内容。 - 提取数据:从解析后的页面中提取所需的数据,例如文本、链接等。

- 存储数据:将提取到的数据存储在本地文件或数据库中,或发送到其他系统进行进一步处理。

- 处理反爬虫机制:如果遇到反爬虫机制,可以采取一些措施来绕过它们,例如使用代理、限制请求频率等。

import requests from bs4 import BeautifulSoup# 1. 发送HTTP请求 url = 'https://www.example.com' response = requests.get(url)# 2. 解析HTML内容 soup = BeautifulSoup(response.text, 'html.parser')# 3. 提取数据 data = [] for item in soup.select('.item'):title = item.select_one('.title').text.strip()rating = item.select_one('.rating').text.strip()data.append((title, rating))# 4. 存储数据到本地文件 with open('data.txt', 'w', encoding='utf-8') as f:for item in data:f.write(f'{item[0]}, {item[1]}\n')print('数据已成功存储到data.txt文件中')# 5. 处理反爬虫机制 import timedef get_page(url):response = requests.get(url)if 'robots' in response.headers['Content-Type']:print('反爬虫机制检测到,等待60秒')time.sleep(60)return get_page(url)return responseresponse = get_page(url) soup = BeautifulSoup(response.text, 'html.parser') data = [] for item in soup.select('.item'):title = item.select_one('.title').text.strip()rating = item.select_one('.rating').text.strip()data.append((title, rating))with open('data.txt', 'w', encoding='utf-8') as f:for item in data:f.write(f'{item[0]}, {item[1]}\n')print('数据已成功存储到data.txt文件中')示例代码

以下是一个简单的Python爬虫示例,用于从豆瓣电影页面获取电影信息并存储到本地文件中:

import requests from bs4 import BeautifulSoup# 目标URL url = 'https://movie.douban.com/top250'# 发送HTTP请求 response = requests.get(url)# 检查请求是否成功 if response.status_code == 200:# 解析HTML内容soup = BeautifulSoup(response.text, 'html.parser')# 提取电影信息movies = []for item in soup.select('.item'):title = item.select_one('.title').text.strip()rating = item.select_one('.rating_num').text.strip()movies.append((title, rating))# 存储电影信息到本地文件with open('movies.txt', 'w', encoding='utf-8') as f:for movie in movies:f.write(f'{movie[0]}, {movie[1]}\n')print('电影信息已成功存储到movies.txt文件中') else:print(f'请求失败,状态码:{response.status_code}')处理反爬虫机制

一些网站会采取反爬虫机制来防止爬虫访问,例如限制请求频率、使用验证码等。以下是一些常见的反爬虫机制及其应对方法:

- 限制请求频率:可以使用

time.sleep()函数在每次请求之间添加延迟,以降低请求频率。 - 使用验证码:可以使用

pytesseract等OCR库来识别验证码,或使用Selenium等工具来模拟浏览器行为以绕过验证码。 - IP封锁:可以使用代理池来切换IP地址,以绕过IP封锁。

最后,如果你也想自学Python,可以关注我。

我还整理出了一套系统的学习路线,这套资料涵盖了诸多学习内容:【点击这里】领取!

包括:Python激活码+安装包、Python web开发,Python爬虫,Python数据分析,人工智能、自动化办公等学习教程。带你从零基础系统性的学好Python!开发工具,基础视频教程,项目实战源码,51本电子书籍,100道练习题等。相信可以帮助大家在最短的时间内,能达到事半功倍效果,用来复习也是非常不错的。

![[Linux]远程登录](https://img-blog.csdnimg.cn/img_convert/ff2bfba73924a1ae5cb79a57d2f5e7ba.png)