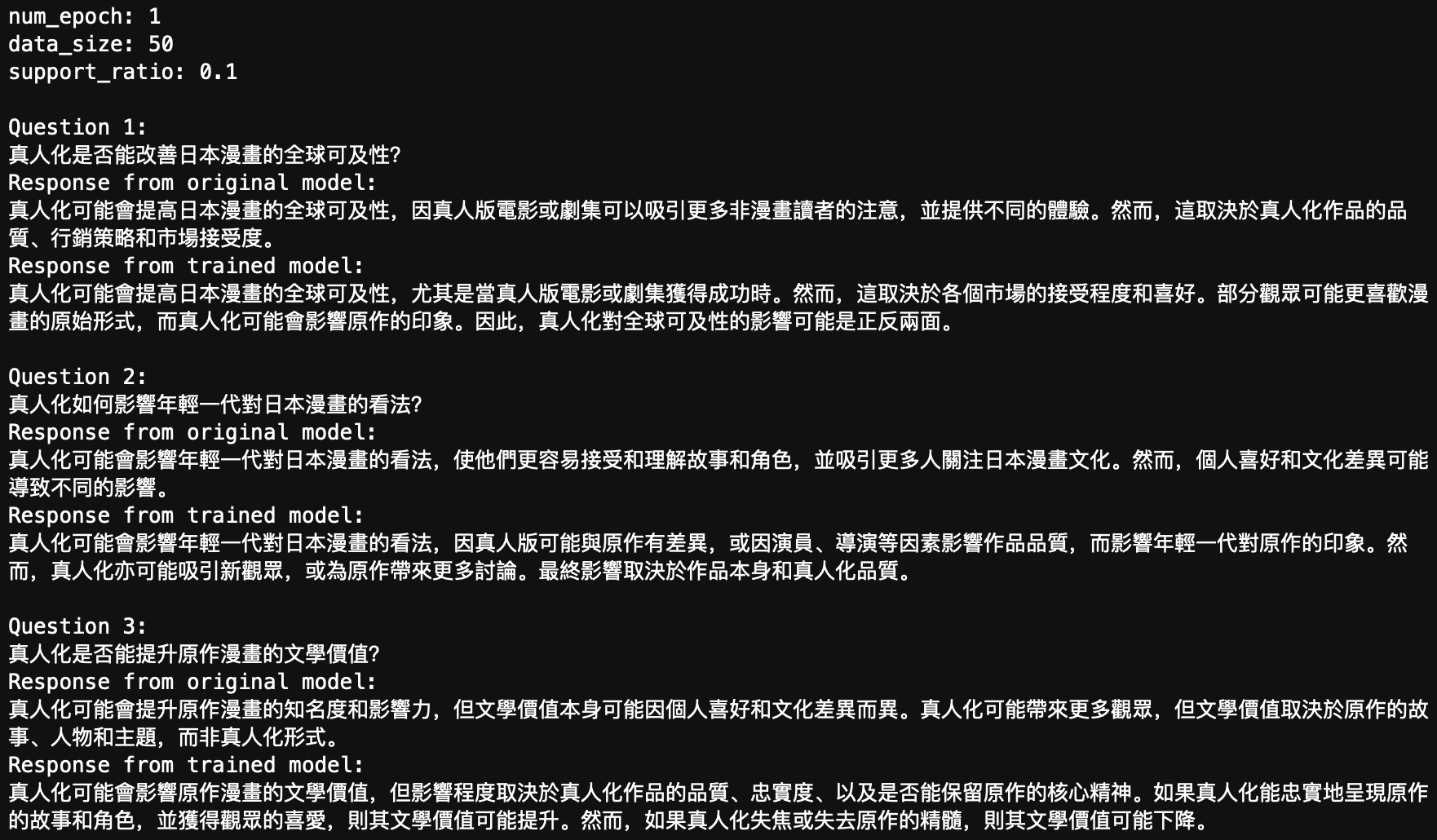

OpenAI o1的思考之前训练扩展定律、后训练扩展定律与推理扩展定律:原理与应用详解

随着深度学习技术的不断发展,模型的规模和复杂度也迅速提升。研究人员发现了模型训练和推理过程中性能变化的规律,这些规律为我们提供了优化模型设计与训练的关键指导原则。本文将详细解析前训练扩展定律(Pre-Training Scaling Laws)、后训练扩展定律(Post-Training Scaling Laws) 以及 推理扩展定律(Inference Scaling Laws) 的原理,并探讨它们在深度学习模型中的应用。

- 传送门链接: 浅谈Scaling Law

1. 前训练扩展定律(Pre-Training Scaling Laws)

1.1 原理概述

前训练扩展定律研究的是模型在预训练阶段,性能如何随着参数规模、数据量和计算资源的增加而变化。这类扩展规律揭示了损失函数(Loss Function)如何随训练规模的扩展逐渐降低,但随着模型规模和数据量的增加,性能提升会逐渐趋缓,出现收益递减现象。

公式描述如下:

L ( N , D , C ) = L 0 + α ⋅ N − β 1 + γ ⋅ D − β 2 + δ ⋅ C − β 3 L(N, D, C) = L_0 + \alpha \cdot N^{-\beta_1} + \gamma \cdot D^{-\beta_2} + \delta \cdot C^{-\beta_3} L(N,D,C)=L0+α⋅N−β1+γ⋅D−β2+δ⋅C−β3

- N N N:模型参数规模

- D D D:训练数据量

- C C C:计算资源

- α , γ , δ \alpha, \gamma, \delta α,γ,δ:权重常数

- β 1 , β 2 , β 3 \beta_1, \beta_2, \beta_3 β1,β2,β3:影响系数,反映参数、数据和资源的收益递减趋势

进一步

为了更深入地理解扩展定律背后的原理,我们可以从损失函数的偏导数分析其收益递减的表现:

-

对参数规模 N N N 求导,得到:

∂ L ∂ N = − β 1 ⋅ α ⋅ N − β 1 − 1 \frac{\partial L}{\partial N} = -\beta_1 \cdot \alpha \cdot N^{-\beta_1-1} ∂N∂L=−β1⋅α⋅N−β1−1

这一公式表明,模型规模越大,损失值下降越慢,即模型性能提升越趋于平稳。

-

对数据量 D D D 和计算资源 C C C 的推导类似,揭示了相同的递减规律。

1.2 参数规模的扩展

增大模型参数规模通常能够提升性能,特别是在模型较小的情况下,这种提升尤为显著。然而,当模型参数量达到一定程度后,增大的效果会显著递减。例如,GPT-3 的实验结果表明,参数从数亿扩展到千亿时,虽然性能有所提升,但边际效益逐渐减少。

案例分析:GPT-3 拥有1750亿参数,在各类NLP任务上表现优异,但由于计算资源消耗巨大,研究人员开始探索通过权衡参数规模与数据量来提高模型的性价比。

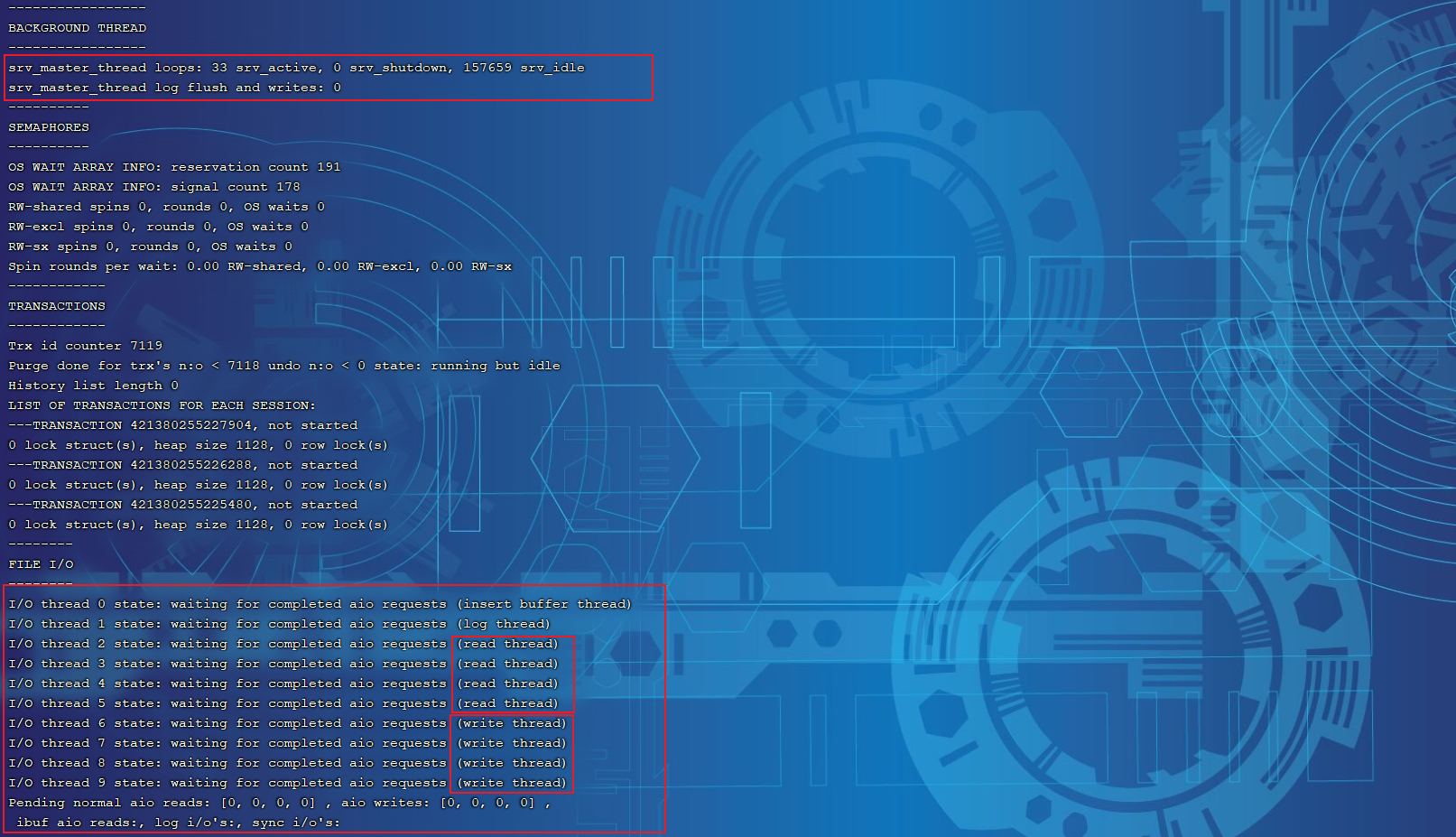

1.3 数据量的扩展

数据量是模型性能提升的另一个关键因素,尤其是对于大规模预训练模型。扩展定律表明,尽管数据的增加带来了性能提升,但在数据量巨大时,增量的收益逐渐减弱。例如,在Chinchilla模型的研究中,通过合理扩展数据集而非盲目增加参数规模,模型表现显著提升。

优化策略:合理增加数据量可以大大提高模型的表现,但需要注意计算资源与训练时间的平衡。

1.4 计算资源的扩展

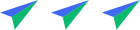

计算资源,如训练轮次(Epochs)和FLOPs(浮点运算次数),对于降低损失值和提升模型性能至关重要。然而,计算资源的扩展同样存在递减效应,因此在推理阶段,采用高效的推理策略,如模型压缩或量化技术,可以极大减少资源消耗。

案例分析:一些大规模预训练模型(如BERT)通过采用参数裁剪和量化等技术,成功在移动端设备上实现高效推理。

实验结果分析

通过在不同数据集和不同模型规模上进行实验对比,研究人员验证了扩展定律的适用性。例如,OpenAI 的研究表明,尽管 GPT-3 在大多数任务上表现良好,Chinchilla 在较少的计算资源条件下,表现出更优的结果。

2. 后训练扩展定律(Post-Training Scaling Laws)

2.1 原理概述

后训练扩展定律 主要描述模型在完成训练后,性能如何随着模型规模、测试数据量 和计算资源的变化而变化。它特别关注模型的泛化能力 和推理效率。

公式描述如下:

E ( N , D test ) = E 0 + μ ⋅ N − θ 1 + ν ⋅ D test − θ 2 E(N, D_{\text{test}}) = E_0 + \mu \cdot N^{-\theta_1} + \nu \cdot D_{\text{test}}^{-\theta_2} E(N,Dtest)=E0+μ⋅N−θ1+ν⋅Dtest−θ2

- E ( N , D test ) E(N, D_{\text{test}}) E(N,Dtest):模型在测试集上的误差

- D test D_{\text{test}} Dtest:测试数据量

- θ 1 , θ 2 \theta_1, \theta_2 θ1,θ2:控制不同因素对误差影响的系数

2.2 泛化能力的提升

后训练扩展定律揭示了在训练完毕后,模型的泛化能力如何随着测试数据量的变化而改变。当模型参数量过大且数据不足时,可能会出现过拟合现象,即模型在训练集上表现良好,但在测试集上的表现不佳。因此,后训练扩展定律为我们提供了数据量与模型规模平衡的理论依据。

2.3 推理效率优化

随着模型规模的不断扩展,推理阶段的计算资源需求也不断增加。后训练扩展定律为我们提供了设计高效推理系统的指导,例如通过模型压缩技术或量化技术来优化推理阶段的效率,特别是在资源受限的设备上,如移动端或嵌入式设备。

3. 推理扩展定律(Inference Scaling Laws)

3.1 原理概述

推理扩展定律(Inference Scaling Laws) 研究的是在推理阶段,性能如何随着模型规模、推理数据集规模 和计算资源的变化而变化。推理扩展定律为我们提供了推理效率与模型性能之间的平衡理论,特别是在大规模推理任务中至关重要。

公式描述如下:

T ( N , D inference , C ) = T 0 + ξ ⋅ N − ϕ 1 + η ⋅ D inference − ϕ 2 + κ ⋅ C − ϕ 3 T(N, D_{\text{inference}}, C) = T_0 + \xi \cdot N^{-\phi_1} + \eta \cdot D_{\text{inference}}^{-\phi_2} + \kappa \cdot C^{-\phi_3} T(N,Dinference,C)=T0+ξ⋅N−ϕ1+η⋅Dinference−ϕ2+κ⋅C−ϕ3

- T ( N , D inference , C ) T(N, D_{\text{inference}}, C) T(N,Dinference,C):推理时间

- D inference D_{\text{inference}} Dinference:推理数据集的规模

- C C C:推理所用的计算资源

- ξ , η , κ \xi, \eta, \kappa ξ,η,κ:影响因素的权重常数

- ϕ 1 , ϕ 2 , ϕ 3 \phi_1, \phi_2, \phi_3 ϕ1,ϕ2,ϕ3:不同因素的递减系数

3.2 推理时间的优化

推理扩展定律揭示了随着模型规模和推理数据集的增加,推理时间的变化趋势。随着模型规模的扩展,推理时间虽然会增加,但通过高效的推理策略,如早停机制(early stopping)和模型裁剪等技术,可以大幅减少推理开销。

案例分析:在大规模图像识别任务中,ResNet 和 EfficientNet 的推理实验表明,尽管 ResNet 的推理时间较长,但在推理阶段采用模型压缩技术可以显著降低计算资源的消耗。

3.3 计算资源的平衡

推理阶段的计算资源与推理效率直接相关,推理扩展定律帮助研究人员在推理效率与模型性能之间找到最佳平衡点。例如,在自动驾驶中的大规模推理任务中,需要确保推理效率高且结果足够准确,因此合理选择模型规模和推理数据集至关重要。

4. 扩展定律的应用与局限性

4.1 超大规模模型的设计

扩展定律为设计超大规模模型提供了重要指导。合理的扩展参数规模和数据量是提升模型性能的核心

原则,但盲目扩展会带来显著的计算资源消耗。因此,研究人员通常采用混合扩展策略,即同时扩展数据量和模型参数量,以实现性能的最优平衡。

实际案例:在GPT-4 的设计中,OpenAI 通过在保持合理计算资源消耗的同时,扩展模型参数量,极大提升了模型在多任务上的表现。

4.2 局限性

虽然扩展定律为模型设计提供了理论依据,但它也有一定的局限性。例如,在实际应用中,不同任务的扩展效应存在差异,因此需要结合实际问题进行调整。此外,扩展定律的适用性在某些特定领域,如小数据集或低计算资源场景下,可能并不完全适用。

5. 结论

扩展定律揭示了深度学习模型性能随着规模、数据量和计算资源的变化趋势。通过深入理解这些规律,研究人员可以更加科学地设计和优化深度学习模型。无论是在训练阶段、推理阶段还是测试阶段,扩展定律都为我们提供了有效的指导,以实现模型性能与资源消耗的最佳平衡。

![World of Warcraft [CLASSIC] International translation bug](https://i-blog.csdnimg.cn/direct/a04cea3d10f040db9bb155618147dca0.jpeg)

![[Redis][String][下]详细讲解](https://i-blog.csdnimg.cn/direct/016fdc7645034405ae3258dac412ecc3.png)