PHP网络爬虫在抓取数据时,常常会遭遇各种反爬策略。这些策略是网站为了保护自身数据不被恶意爬取而设置的。以下是一些常见的PHP网络爬虫反爬策略:

-

IP限制:

- 这是最常见的反爬虫技术。通过限制IP的访问,可以有效防止恶意的爬虫攻击。

- 为了应对这种反爬策略,PHP网络爬虫可以使用代理服务器,轮流更换IP来绕过IP限制。此外,还可以使用分布式爬虫,将任务分配到多台计算机上,从而增加了访问目标站点的IP数量和多样性。

-

验证码验证:

- 验证码是常用的反爬虫技术,通过在请求中加入验证码,来防止爬虫自动获取网站信息。

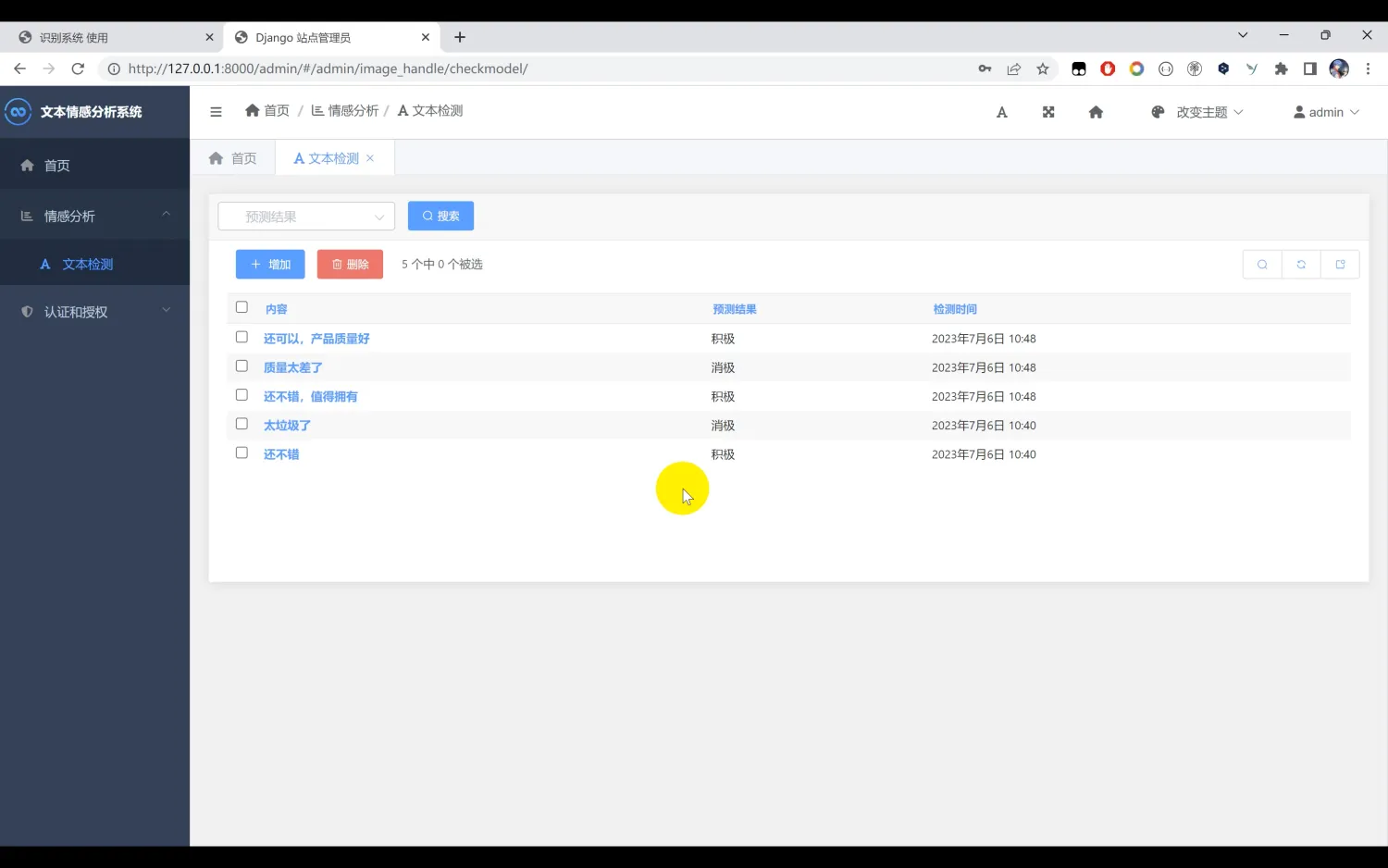

- 对于PHP网络爬虫来说,可以使用自动化的验证码识别工具来解决这个问题,但需要注意,验证码识别并非总能成功,且可能涉及法律和道德问题。

-

频率限制:

- 这是一种限制每个IP地址在单位时间内访问某一网站的数量的反爬技术。

- 如果爬虫请求太过频繁,目标网站就会触发频率限制,导致无法获取数据。

- 为了应对这种反爬虫技术,PHP网络爬虫可以选择减少请求频率、将访问任务分散到多个IP上、或者使用随机间隔的访问方式等方法来规避风险。

-

User-Agent检测:

- 在HTTP请求中,User-Agent是一个用于识别客户端应用程序、操作系统、硬件设备等信息的标识。

- 反爬虫的常见方法之一就是根据User-Agent进行识别和限制。

- PHP网络爬虫可以通过设置User-Agent,来让爬虫发送的请求看起来像是来自于浏览器的请求,从而绕过这一限制。

-

JavaScript检测:

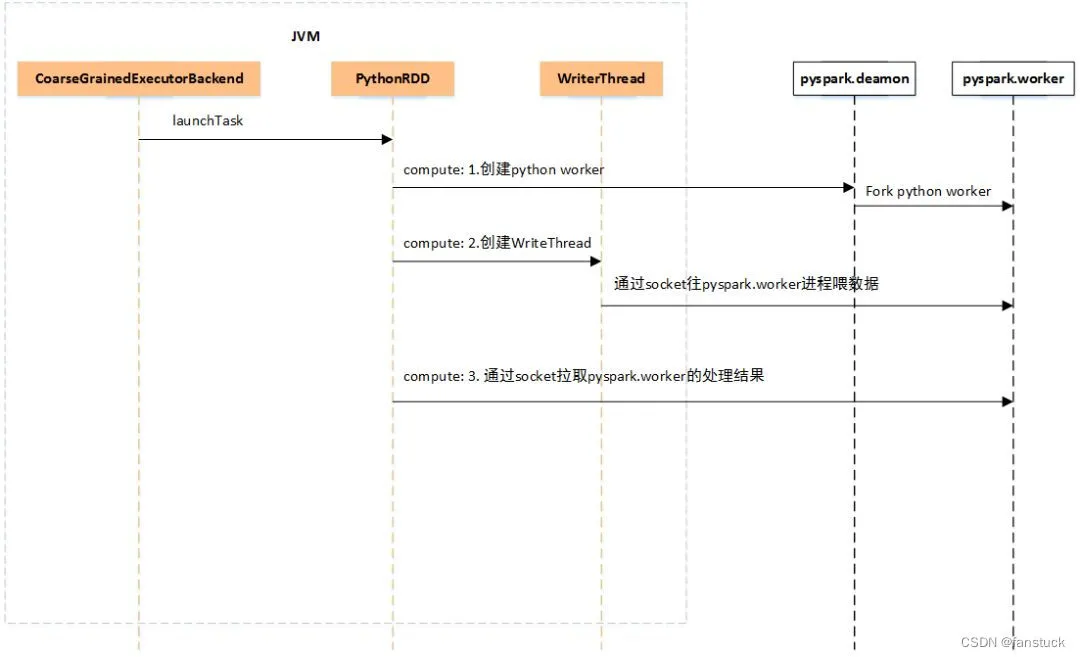

- 一些网站会通过JavaScript来检测访问者的浏览器和设备信息,从而判断是否是爬虫。

- 为了解决这个问题,PHP网络爬虫可以模拟浏览器行为,如真实的请求头信息、Cookie等,或者使用头信息池等技术来欺骗JavaScript检测。

-

模拟登录限制:

- 一些网站会要求用户登录才能获取信息,此时PHP网络爬虫需要进行模拟登录才能获取所需数据。

- 对于需要登录的网站,PHP网络爬虫可以使用模拟用户登录的方式来获取数据,从而绕过反爬虫的限制。

综上所述,PHP网络爬虫在抓取数据的过程中,需要了解并应对各种反爬策略。同时,也需要遵守网站的规则和法律法规,确保使用爬虫技术的合法性。