深度学习中的注意力机制

在深度学习领域,注意力机制(Attention Mechanism)已经成为近年来最受瞩目的研究热点之一。它不仅提升了现有模型的性能,更启发了全新的网络结构,如Transformer模型。注意力机制被广泛应用于自然语言处理(NLP)、计算机视觉(CV)以及语音处理等领域。

1. 什么是注意力机制?

要理解注意力机制,首先要了解其原理。注意力机制的灵感来自于人类的认知过程。当我们观察复杂场景时,视觉系统并不会同时处理所有信息,而是会选择性地关注某些重要部分。例如,当我们读一篇文章时,我们不会一次性记住每个单词,而是会根据上下文对某些单词给予更多关注。

机器学习中的注意力机制模仿了这一过程。在传统的序列模型(如RNN或LSTM)中,模型通常会处理整个输入序列,然后生成一个输出向量。然而,在这个过程中,模型可能会忽略某些重要的信息,尤其是对于较长的序列。注意力机制通过为每个输入元素分配一个权重,来帮助模型关注重要信息,从而生成更为有效的输出。

1.1 基本公式

注意力机制的核心公式可以表示为:

![[

\text{Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right)V

]](https://i-blog.csdnimg.cn/direct/44242a5775104eb8846cdd92ecdfb12b.png)

- Query (Q):查询向量,代表了需要聚焦的输入部分。

- Key (K):键向量,表示输入序列中的每个元素。

- Value (V):值向量,表示需要提取的信息。

- (d_k):键向量的维度,常用于缩放处理,避免内积结果过大。

1.2 为什么需要注意力机制?

传统的RNN和LSTM结构虽然能处理序列数据,但在处理较长的序列时,容易出现信息遗忘问题(如梯度消失)。注意力机制通过为每个输入位置计算不同的权重,使模型能够动态地关注特定位置的输入,从而有效缓解序列长度对模型性能的影响。

例如,在机器翻译任务中,目标是将一个句子从源语言翻译为目标语言。在经典的Seq2Seq模型中,编码器会对整个源句子进行编码,然后解码器基于这一编码生成目标句子。然而,对于长句子来说,模型很容易在解码过程中丢失重要的上下文信息。通过加入注意力机制,解码器可以根据当前的翻译位置动态选择源句子中的相关部分,从而生成更准确的翻译。

2. 注意力机制的应用场景

随着注意力机制的提出和发展,它已经在许多领域中得到了广泛应用。以下是几个主要的应用场景:

2.1 自然语言处理

注意力机制最初在自然语言处理领域得到了广泛应用。它被用来解决序列到序列(Seq2Seq)模型中的信息遗失问题。例如,在机器翻译任务中,注意力机制帮助模型在生成每个目标词时动态选择源句子中最相关的部分。

此外,注意力机制在文本摘要、对话生成、问题回答等任务中也起到了重要作用。例如,Transformer模型的引入彻底改变了NLP领域,它通过完全抛弃RNN结构,依赖注意力机制实现了极大的性能提升。

2.2 计算机视觉

在计算机视觉领域,注意力机制被广泛应用于图像识别、目标检测和图像生成等任务。例如,在目标检测任务中,注意力机制可以帮助模型专注于图像中最相关的区域,从而更准确地检测目标。

经典的卷积神经网络(CNN)虽然能有效处理图像数据,但由于卷积核的局限性,它在处理全局依赖关系时表现较差。注意力机制的引入,让模型能够在全局范围内选择性地关注图像中的某些区域,从而提升了识别效果。

2.3 语音处理

在语音识别和语音生成任务中,注意力机制也被广泛应用。尤其是在语音生成中,注意力机制帮助模型聚焦于不同的时间帧,从而生成更为流畅的语音信号。例如,基于Transformer的语音识别系统,已经在许多任务中取得了领先的效果。

3. 常见的注意力机制模型

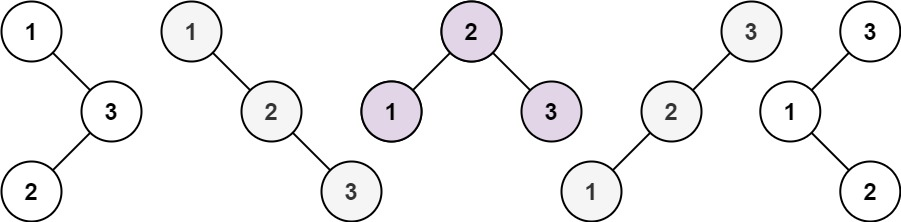

注意力机制根据实现方式和应用场景的不同,可以分为几种不同的类型。接下来我们会详细探讨几种常见的注意力机制模型。

3.1 基本的注意力机制

基本的注意力机制通常用于经典的序列到序列模型中,最早应用于机器翻译任务。在这种机制中,输入序列中的每个元素(即词向量)都会被赋予一个权重,这些权重表示模型在生成输出时对该元素的关注程度。通过加权求和,模型能够动态地聚焦于输入序列中最相关的信息。

假设输入序列为 (X = {x_1, x_2, …, x_n}),输出为 (Y = {y_1, y_2, …, y_m})。在生成 (y_i) 时,模型会根据输入序列中的每个元素计算出注意力权重 (a_{ij}),然后根据这些权重对输入进行加权求和,生成新的输出。

3.2 Transformer中的多头注意力机制

Transformer是基于注意力机制的模型架构,其核心创新点是多头注意力机制(Multi-Head Attention)。在多头注意力机制中,输入数据会被拆分成多个部分,每个部分使用独立的注意力头进行处理,这样模型可以在多个不同的子空间中关注不同的信息。

多头注意力机制的工作原理可以描述为:将输入向量分别映射为查询(Query)、键(Key)和值(Value)向量,并通过多个注意力头计算每个子空间中的加权和,最后将所有头的输出拼接在一起,形成最终的输出。

公式如下:

其中,每个头的计算方式为:

3.3 自注意力机制(Self-Attention)

自注意力机制是Transformer模型的另一个重要组成部分。在传统的注意力机制中,查询向量和键值向量通常来自不同的序列,而在自注意力机制中,查询、键和值都来自同一个序列。这意味着序列中的每个位置都能够与其他所有位置进行交互,从而捕捉到序列中的全局依赖关系。

自注意力机制的计算方式与基本注意力机制类似,只不过这里的查询、键和值都来自同一个输入序列。

4. 实际代码实现

4.1 实现简单的注意力机制

为了帮助理解注意力机制的工作原理,下面我们将实现一个简单的注意力机制模型。该模型会对输入序列中的每个元素进行加权,然后根据权重对序列进行加权求和,生成最终的输出。

import torch

import torch.nn as nn

import torch.nn.functional as Fclass SimpleAttention(nn.Module):def __init__(self, input_dim):super(SimpleAttention, self).__init__()# 定义一个线性层,用于将输入映射为注意力分数self.attention = nn.Linear(input_dim, 1)def forward(self, x):# x 的形状为 (batch_size, seq_len, input_dim)# 通过线性变换生成注意力分数attn_weights = F.softmax(self.attention(x), dim=1)# 根据注意力权重对输入进行加权求和weighted_sum = torch.sum(attn_weights * x, dim=1)return weighted_sum, attn_weights# 创建一个简单的输入,模拟一个批次的数据

batch_size = 3

seq_len = 5

input_dim = 4

x = torch.rand(batch_size, seq_len, input_dim)# 初始化模型并进行前向传播

model = SimpleAttention(input_dim)

output, attention_weights = model(x)print("输出向量:", output)

print("注意力权重:", attention_weights)

在这个示例中,模型会根据输入序列中的每个元素生成一个权重,然后使用这些权重对输入序列进行加权求和。通过这种方式,模型能够动态地

聚焦于输入序列中最重要的信息。

4.2 实现多头注意力机制

多头注意力机制是Transformer模型的核心组件,能够在不同的子空间中并行计算多个注意力分数,从而捕捉到更丰富的信息。以下是一个多头注意力机制的实现示例:

import torch

import torch.nn as nnclass MultiHeadAttention(nn.Module):def __init__(self, embed_size, heads):super(MultiHeadAttention, self).__init__()self.embed_size = embed_sizeself.heads = headsself.head_dim = embed_size // headsassert self.head_dim * heads == embed_size, "Embedding size needs to be divisible by heads"# 为不同的头定义线性层self.values = nn.Linear(self.head_dim, embed_size, bias=False)self.keys = nn.Linear(self.head_dim, embed_size, bias=False)self.queries = nn.Linear(self.head_dim, embed_size, bias=False)self.fc_out = nn.Linear(embed_size, embed_size)def forward(self, values, keys, query):N = query.shape[0]value_len, key_len, query_len = values.shape[1], keys.shape[1], query.shape[1]# 将输入分成多个头values = values.reshape(N, value_len, self.heads, self.head_dim)keys = keys.reshape(N, key_len, self.heads, self.head_dim)queries = query.reshape(N, query_len, self.heads, self.head_dim)# 计算每个头的注意力分数energy = torch.einsum("nqhd,nkhd->nhqk", [queries, keys])attention = torch.softmax(energy / (self.embed_size ** (1 / 2)), dim=3)# 根据注意力分数对值进行加权求和out = torch.einsum("nhql,nlhd->nqhd", [attention, values]).reshape(N, query_len, self.embed_size)# 将结果通过全连接层输出out = self.fc_out(out)return out

在这个实现中,输入数据会被分成多个子空间,并在每个子空间中独立计算注意力分数。最终的结果会被拼接在一起,形成多头注意力的输出。

4.3 自注意力机制的实现

自注意力机制(Self-Attention)是Transformer的关键组件,用于捕捉序列中的全局依赖关系。通过自注意力机制,序列中的每个位置可以与其他所有位置进行交互,从而更好地理解上下文信息。

import torch

import torch.nn as nnclass SelfAttention(nn.Module):def __init__(self, embed_size, heads):super(SelfAttention, self).__init__()# 使用 PyTorch 内置的 MultiheadAttention 模块self.multihead_attn = nn.MultiheadAttention(embed_dim=embed_size, num_heads=heads)def forward(self, x):# 使用自身作为查询、键和值,计算自注意力attn_output, attn_weights = self.multihead_attn(x, x, x)return attn_output, attn_weights# 示例:5个时间步长,3个样本,嵌入维度为4,头数为2

x = torch.rand(5, 3, 4)

self_attention = SelfAttention(embed_size=4, heads=2)

output, weights = self_attention(x)print("输出:", output)

print("注意力权重:", weights)

在这个实现中,我们使用了PyTorch内置的MultiheadAttention模块,它可以方便地实现自注意力机制。在前向传播时,输入序列的查询、键和值都是相同的,从而实现序列内部的全局依赖关系捕捉。

5. 深化理解:自注意力在Transformer中的角色

在Transformer架构中,自注意力机制被广泛应用于编码器和解码器中。编码器通过多层自注意力机制和前馈网络,逐步提取序列中的信息,而解码器则利用自注意力机制和编码器-解码器注意力机制生成目标序列。

自注意力的优势在于,它能高效地并行处理序列数据,而不像RNN那样需要逐个时间步处理。此外,自注意力还能捕捉到远距离的依赖关系,这在长序列任务(如文本生成或翻译)中特别有用。

6. 总结

注意力机制的提出和发展,极大地改变了深度学习领域的格局。它通过为模型提供动态聚焦的能力,解决了许多经典模型中存在的长距离依赖问题,并在诸如机器翻译、图像识别、语音生成等任务中取得了显著的成果。尤其是Transformer模型的成功,更是证明了注意力机制的巨大潜力。

随着研究的深入,我们可以预见,注意力机制将在更多的领域中得到广泛应用。对于研究者和工程师来说,理解并掌握这一技术,将是应对未来复杂任务的关键。